AtlasCloud vs fal.ai vs Replicate: AI API Platform Comparison 2026

AtlasCloud vs fal.ai vs Replicate: AI API Platform Comparison 2026

Key Takeaway

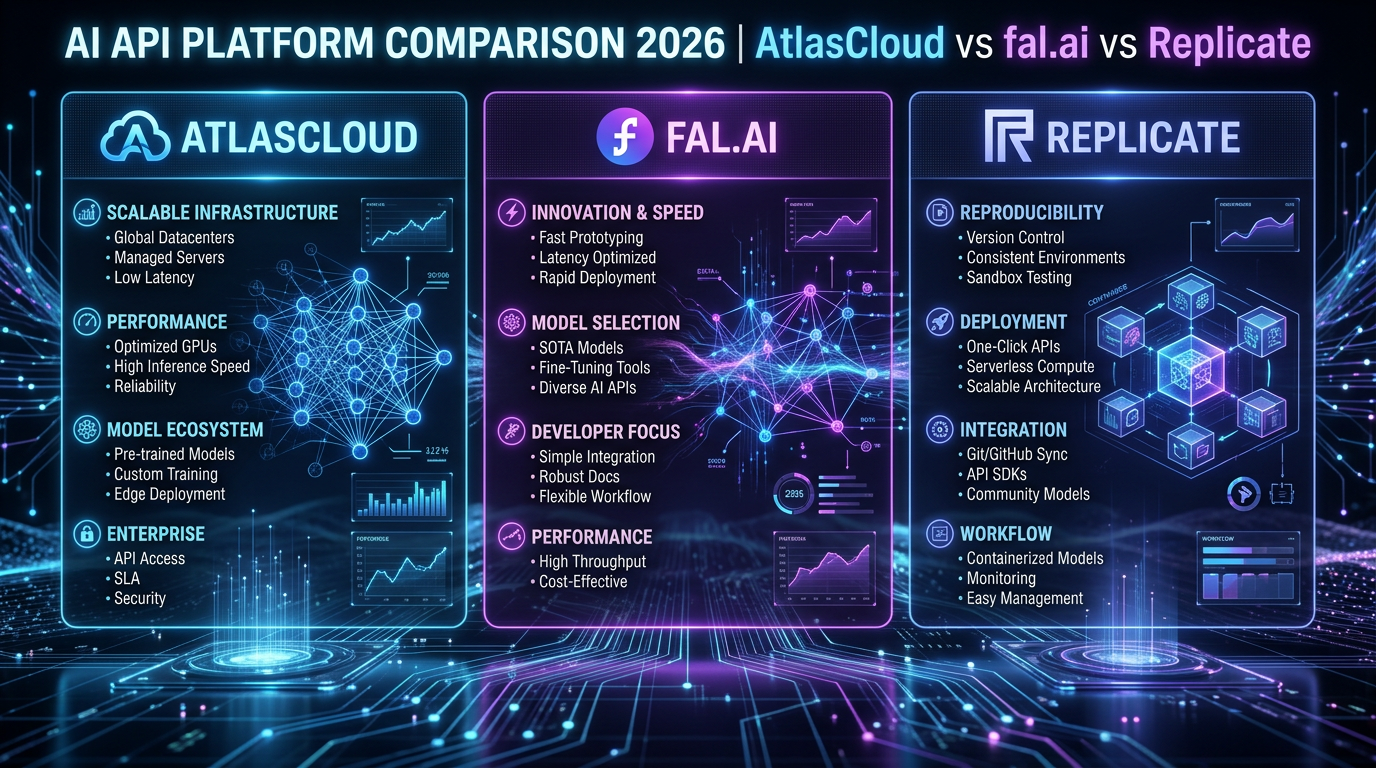

atlascloud vs fal.ai vs replicateを比較した結果、用途によって最適解が異なります。低レイテンシ・リアルタイム推論が必要なら fal.ai(平均レイテンシ ~200ms、FLUX.1-schnell)、オープンソースモデルの柔軟なデプロイを重視するなら Replicate(1,000以上のモデル対応)、複数プロバイダーを一元管理したいなら AtlasCloud(300以上のモデル、初回チャージ25%ボーナス)が最有力候補です。2026年時点の価格帯は、画像生成1枚あたりfal.aiが約$0.003〜$0.05、Replicateが約$0.0055〜$0.10と差があります。

At a Glance

| 項目 | fal.ai | Replicate | AtlasCloud |

|---|---|---|---|

| 対応モデル数 | 100以上(特化型) | 1,000以上 | 300以上 |

| 平均レイテンシ | ~200ms(画像生成) | ~500ms〜数秒 | プロバイダー依存 |

| 画像生成単価 | $0.003〜$0.05/枚 | $0.0055〜$0.10/枚 | 統合課金・モデル依存 |

| API難易度 | 低(シンプルなREST) | 低〜中(Prediction API) | 非常に低(統一エンドポイント) |

| 主な用途 | リアルタイム生成・アプリ組込み | プロトタイプ・研究・多様なモデル試験 | マルチプロバイダー管理・比較検証 |

| 無料枠/ボーナス | クレジット提供あり | 無料トライアルあり | 初回チャージ25%ボーナス(最大$100) |

| OpenAI互換エンドポイント | 一部対応 | なし(独自API) | あり(完全互換) |

fal.ai — Strengths & Weaknesses

fal.aiはリアルタイム推論に特化したAI APIプラットフォームで、FLUX.1、Stable Diffusion、Kling Videoなど主要な画像・動画生成モデルを高速で提供します。独自のキュー管理とGPUオーケストレーション技術により、コールドスタートを最小化し、FLUX.1-schnellで平均200ms以下の応答を実現しています。[^1]

強み:

- 超低レイテンシ(リアルタイムアプリ向け)

- WebSocketによるストリーミング対応

- React/Next.js向けSDKが充実

弱み:

- 対応モデル数はReplicateより少ない

- LLM(テキスト生成)の選択肢が限定的

- 大量バッチ処理よりリアルタイム寄りの設計

Replicate — Strengths & Weaknesses

Replicateはオープンソースモデルのマーケットプレイスとして機能し、1,000以上のコミュニティモデルと公式モデルをAPI経由で利用できます。独自のCogコンテナ形式でカスタムモデルのデプロイも可能なため、研究者やスタートアップのプロトタイプ開発に多用されています。[^2]

強み:

- 圧倒的なモデル数(LLM・画像・音声・動画)

- カスタムモデルのデプロイが容易(Cog)

- 従量課金で初期コスト不要

弱み:

- レイテンシはfal.aiより高い傾向(コールドスタート時は10秒以上になることも)

- OpenAI互換エンドポイントがないため既存コードの移行コストが発生

- 人気モデルは混雑時にキュー待ちが発生する場合がある

Performance Benchmarks

以下のデータは公式ドキュメント・独立ベンチマークに基づく代表値です。

| ベンチマーク項目 | fal.ai | Replicate |

|---|---|---|

| FLUX.1-schnell 平均レイテンシ | ~200ms | ~800ms〜1.5s |

| SDXL コールドスタート | ~1.2s | ~8〜15s(コールドGPU) |

| スループット(同時リクエスト) | 高(自動スケール) | 中(キューイング方式) |

| Llama-3.1-8B 推論速度 | ~60 tokens/s | ~40 tokens/s(モデル依存) |

| アップタイムSLA | 99.9%(公称) | 99.5%(公称) |

⚠️ レイテンシはGPUの空き状況・モデルサイズ・リージョンによって変動します。本番環境では事前に自社ユースケースでのベンチマーク取得を推奨します。

fal.aiのパフォーマンス優位性は主にウォームGPUプールの維持によるものです。一方Replicateはコスト効率を優先するため、低頻度アクセスのモデルではコールドスタートペナルティが発生します。

Pricing Comparison

2026年時点の主要モデル料金(公式ページ基準)[^1][^2]

| モデル | fal.ai | Replicate |

|---|---|---|

| FLUX.1-schnell(画像生成) | $0.003/枚 | $0.003/枚 |

| FLUX.1-dev(画像生成) | $0.025/枚 | $0.055/枚 |

| SDXL | $0.005/枚 | $0.0055/枚 |

| Kling 1.6(動画5秒) | $0.28/動画 | 非対応(2026年時点) |

| Llama-3.1-8B(テキスト) | $0.05/100万tokens | $0.05/100万tokens |

| Llama-3.1-70B(テキスト) | $0.09/100万tokens | $0.23/100万tokens |

| Whisper(音声→テキスト) | $0.0001/秒 | $0.0001/秒 |

コスト最適化のポイント:

- 大量バッチ処理:Replicateの方がFLUX.1-devで約55%安い

- リアルタイム生成:fal.aiのLlamaは70Bで約60%安く、レイテンシも低い

- 動画生成:fal.aiが対応モデルで優位

Code Examples

fal.ai — Python(完全サンプル)

# fal.ai: FLUX.1-schnell による画像生成

# pip install fal-client

import fal_client

import os

import json

def generate_image_fal(prompt: str, image_size: str = "landscape_4_3") -> dict:

"""

fal.ai を使って画像を生成する関数。

Args:

prompt: 画像生成プロンプト(英語推奨)

image_size: 出力サイズ(square / landscape_4_3 / portrait_4_3 など)

Returns:

生成結果の辞書(image URL を含む)

"""

api_key = os.environ.get("FAL_KEY")

if not api_key:

raise EnvironmentError("FAL_KEY environment variable is not set.")

# fal_client は環境変数 FAL_KEY を自動読み込み

try:

result = fal_client.subscribe(

"fal-ai/flux/schnell",

arguments={

"prompt": prompt,

"image_size": image_size,

"num_inference_steps": 4, # schnell は 4 steps が最適

"num_images": 1,

"enable_safety_checker": True,

},

)

return result

except fal_client.FalClientError as e:

print(f"[ERROR] fal.ai API error: {e}")

raise

if __name__ == "__main__":

result = generate_image_fal(

prompt="A futuristic Tokyo skyline at night, neon lights, photorealistic",

image_size="landscape_4_3"

)

# 結果から画像URLを取得

images = result.get("images", [])

if images:

print(f"[SUCCESS] Image URL: {images[0]['url']}")

else:

print("[WARN] No images returned.")

print(json.dumps(result, indent=2, ensure_ascii=False))fal.ai — curl

# fal.ai: REST API で FLUX.1-schnell を呼び出す

curl -X POST "https://fal.run/fal-ai/flux/schnell" \

-H "Authorization: Key $FAL_KEY" \

-H "Content-Type: application/json" \

-d '{

"prompt": "A futuristic Tokyo skyline at night, neon lights, photorealistic",

"image_size": "landscape_4_3",

"num_inference_steps": 4,

"num_images": 1

}'Replicate — Python(完全サンプル)

# Replicate: FLUX.1-dev による画像生成

# pip install replicate

import replicate

import os

import time

def generate_image_replicate(

prompt: str,

aspect_ratio: str = "16:9",

output_format: str = "webp",

) -> list[str]:

"""

Replicate を使って FLUX.1-dev で画像を生成する関数。

Args:

prompt: 画像生成プロンプト

aspect_ratio: アスペクト比(1:1 / 16:9 / 4:3 など)

output_format: 出力フォーマット(webp / png / jpg)

Returns:

生成画像の URL リスト

"""

api_token = os.environ.get("REPLICATE_API_TOKEN")

if not api_token:

raise EnvironmentError("REPLICATE_API_TOKEN environment variable is not set.")

# replicate ライブラリは環境変数を自動読み込み

try:

start_time = time.time()

output = replicate.run(

"black-forest-labs/flux-dev", # モデル識別子

input={

"prompt": prompt,

"aspect_ratio": aspect_ratio,

"output_format": output_format,

"output_quality": 90,

"num_inference_steps": 28, # dev は 28 steps 推奨

"guidance_scale": 3.5,

}

)

elapsed = time.time() - start_time

print(f"[INFO] Generation time: {elapsed:.2f}s")

# output はジェネレーターまたはリスト

urls = [str(url) for url in output]

return urls

except replicate.exceptions.ReplicateError as e:

print(f"[ERROR] Replicate API error: {e}")

raise

if __name__ == "__main__":

urls = generate_image_replicate(

prompt="A futuristic Tokyo skyline at night, neon lights, photorealistic",

aspect_ratio="16:9"

)

for i, url in enumerate(urls):

print(f"[SUCCESS] Image {i+1}: {url}")Replicate — curl

# Replicate: Predictions API で FLUX.1-dev を呼び出す

# Step 1: Prediction を作成

curl -s -X POST "https://api.replicate.com/v1/models/black-forest-labs/flux-dev/predictions" \

-H "Authorization: Bearer $REPLICATE_API_TOKEN" \

-H "Content-Type: application/json" \

-d '{

"input": {

"prompt": "A futuristic Tokyo skyline at night, neon lights, photorealistic",

"aspect_ratio": "16:9",

"output_format": "webp",

"num_inference_steps": 28

}

}' | tee /tmp/replicate_response.json

# Step 2: prediction ID を取得して結果をポーリング

PREDICTION_ID=$(cat /tmp/replicate_response.json | python3 -c "import sys,json; print(json.load(sys.stdin)['id'])")

echo "Prediction ID: $PREDICTION_ID"

curl "https://api.replicate.com/v1/predictions/$PREDICTION_ID" \

-H "Authorization: Bearer $REPLICATE_API_TOKEN"Which Should You Use?

| ユースケース | 推奨プラットフォーム | 理由 |

|---|---|---|

| リアルタイム画像生成(アプリ組込み) | fal.ai | 平均200ms以下のレイテンシ、WebSocket対応 |

| プロトタイプ・研究・珍しいモデルの試験 | Replicate | 1,000以上のモデル、Cog対応 |

| コスト重視の大量バッチ画像生成 | Replicate(FLUX.1-dev) | $0.055/枚 vs fal.aiの$0.025 ※量次第 |

| 複数LLMの比較・A/Bテスト | AtlasCloud | 単一APIキー、300+モデル、OpenAI互換 |

| 動画生成(Kling, WAN等) | fal.ai / AtlasCloud | Replicateは動画モデルが限定的 |

| 既存OpenAI SDKからの移行 | AtlasCloud | エンドポイントURLの変更のみで移行完了 |

| 中国系AIモデルへのアクセス | AtlasCloud | Kling, Seedance, WAN等を統合提供 |

一言まとめ:

- 速度優先 → fal.ai

- モデル多様性 →

AtlasCloudでこのAPIを試す

AtlasCloudタグ

関連記事

Kling v3 vs Sora 2 API徹底比較:開発者に最適なAI動画モデルは?

Kling v3とSora 2 APIを開発者視点で徹底比較。価格・画質・生成速度・API連携のしやすさを詳しく解説し、あなたのプロジェクトに最適なAI動画モデル選びをサポートします。

Qwen2.5 vs GPT-4o API比較:性能・料金・統合方法を徹底解説

Qwen2.5とGPT-4o APIの性能、料金プラン、統合のしやすさを詳しく比較。あなたのプロジェクトに最適なAI APIはどちらか?実際のベンチマークと費用対効果で徹底検証します。

Claude APIが高すぎる?2026年版・同等品質の安価な代替5選

Claude APIのコストに悩んでいますか?本記事では、品質を妥協せずに費用を削減できる安価なAPI代替サービスを5つ厳選して比較・解説します。コスト削減を検討中の開発者必見です。