統合AI APIプラットフォームとは?2026年に開発者が乗り換える理由

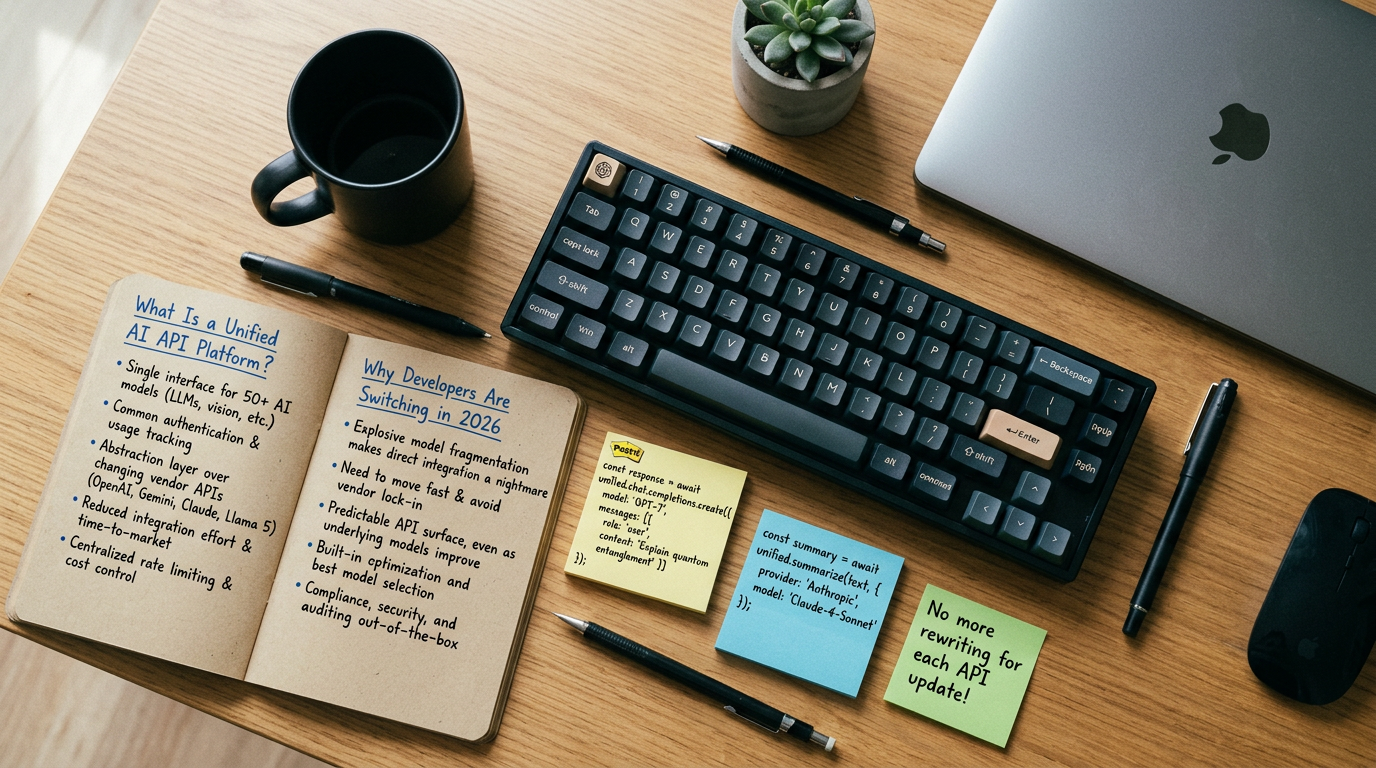

Unified AI API Platformとは何か?2026年に開発者が乗り換える理由

一言で答えると: Unified AI API Platformとは、複数のAIモデルとプロバイダーへのアクセスを単一のAPIエンドポイントに集約するインフラ層のことだ。ai.ccの定義によれば、「アプリケーションコードを変更せずに、モデルの切り替え・使用量管理・コスト制御が可能な標準化されたインターフェース」である。2026年時点では、主要なOne API aggregationプラットフォームが最大80%のコスト削減を実現するケースが報告されており(Commercial Appeal, 2026)、エンタープライズからスタートアップまで、この移行が加速している。

なぜ今これが重要なのか:2026年のAIコスト危機

問題は単純だ。AIモデルの数が増えすぎた。

2024年頃まで、多くの開発チームはOpenAI・Anthropic・Google・Mistralなどのプロバイダーと個別に契約し、それぞれのSDKを保守していた。DIMA AIが指摘するように、「5つの別々のAIサブスクリプションを管理する時代は終わりつつある」。

実際の運用コストを分解すると:

| コスト要因 | 個別API管理 | Unified Platform |

|---|---|---|

| プロバイダーごとの認証管理 | 各プロバイダーで個別実装 | 単一の認証フロー |

| モデル切り替え時のコード変更 | 必要(インターフェースが異なる) | 不要(パラメータ変更のみ) |

| レート制限・フォールバック実装 | 自前で構築が必要 | プラットフォーム側で処理 |

| 請求の一元化 | 複数の請求書・通貨・サイクル | 単一ダッシュボード |

| 障害時の切り替えコスト | 数時間〜数日 | 設定変更のみ(分単位) |

この「隠れたコスト」こそが、開発者がUnified Platformへ移行する主因だ。トークン単価ではなく、運用オーバーヘッドが問題になっている。

Unified AI API Platformの構造を理解する

Unified Platformは「ただのプロキシ」ではない。アーキテクチャには明確な層構造がある。

Layer 1:API抽象化層(Translation Layer)

各プロバイダーのAPIは微妙に異なる。OpenAIはmessages配列を使い、Anthropicはsystemフィールドを別パラメータとして要求し、Geminiはまた別の構造を持つ。Unified Platformの中核は、この異なるスキーマを単一のリクエスト形式に正規化することだ。

開発者がmodel: "anthropic/claude-opus-4"と書けば、プラットフォームが内部でAnthropicのAPI形式に変換し、レスポンスも統一フォーマットで返す。コードは変えない。

Layer 2:ルーティング・フォールバック層

これが単純なプロキシとの決定的な違いだ。

- Cost-based routing:同等性能のモデルのうち、リアルタイムで最も安いものを選択

- Latency-based routing:レスポンス速度を優先してモデルを動的に選択

- Fallback chain:GPT-4oが503を返したら自動でClaude 3.5 Sonnetへフォールバック

- Load balancing:同一モデルの複数エンドポイントにトラフィックを分散

Layer 3:可観測性・ガバナンス層

エンタープライズが特に重視する機能がここに集中する。

- Usage tracking:チーム・プロジェクト・ユーザーごとのトークン使用量

- Budget guardrails:月次予算の上限設定と自動停止

- Audit logs:どのモデルがいつ・何のリクエストを処理したかの完全な記録

- PII filtering:センシティブデータのマスキング(コンプライアンス対応)

主要プラットフォームの比較

unified.toの調査によれば、「Unified API」とラベルされたプラットフォームは、アーキテクチャ・データハンドリング・価格設定・運用成熟度において大きく異なる」。評価軸を整理する。

機能比較表(2026年主要プレイヤー)

| プラットフォーム | 対応モデル数 | Fallback機能 | Cost routing | セルフホスト | 主なターゲット |

|---|---|---|---|---|---|

| LiteLLM | 100+ | ✅ | ✅ | ✅ | 開発者・中小企業 |

| OpenRouter | 200+ | ✅ | ✅ | ❌ | 個人〜中規模チーム |

| AWS Bedrock | 30+ | 部分的 | ❌(手動設定) | ❌(AWS依存) | エンタープライズ |

| Azure AI Foundry | 50+ | ✅ | 部分的 | ❌ | Microsoftエコシステム |

| Portkey | 250+ | ✅ | ✅ | ✅ | エンタープライズ |

| HelixML | 40+ | ✅ | ❌ | ✅ | プライバシー重視 |

注意:対応モデル数は公称値であり、実際の本番稼働品質のモデル数は異なる場合がある。プロダクションで使用する前に、必要なモデルの安定性を個別に検証すること。

コスト・パフォーマンス分析

同一ワークロード(月間1億トークン、GPT-4o相当クラス)での概算比較:

| シナリオ | 月間コスト(概算) | 運用工数 | 備考 |

|---|---|---|---|

| OpenAI直接(固定) | $300〜$500 | 低(単一SDK) | 価格変動リスクあり |

| 複数プロバイダー個別管理 | $200〜$400 | 高(複数SDK保守) | コード複雑性が増大 |

| Unified Platform(Cost routing有効) | $60〜$150 | 低〜中 | 最大80%削減の根拠はここ |

| Unified Platform(セルフホスト) | インフラ費用のみ | 高(保守責任) | 大規模組織向け |

コスト削減の80%という数字は、固定モデル利用から動的ルーティングへの切り替え効果が大きい。同等のタスクでもGPT-4oではなくgemini-flash-2.0やmistral-small-3.1で十分な場合、自動的にコストの低いモデルにルーティングされる。

実装:最初の統一リクエストを送る

概念より実装で理解が深まる。以下はLiteLLMを使った例で、コードを変えずに3つのモデルを切り替えられるという非自明な動作を示す。

from litellm import completion

# この関数はモデル名を変えるだけで、OpenAI・Anthropic・Geminiすべてで動作する

def ask_model(model_name: str, user_message: str) -> str:

response = completion(

model=model_name,

messages=[{"role": "user", "content": user_message}],

# fallbacksを設定: primary失敗時に自動切り替え

fallbacks=["anthropic/claude-3-5-sonnet-20241022", "gemini/gemini-2.0-flash"],

# 予算ガードレール

max_budget=0.01, # このリクエストの上限: $0.01

)

return response.choices[0].message.content

# 以下3行はすべて同じインターフェースで動作する

result_a = ask_model("gpt-4o", "Pythonの非同期処理を説明して")

result_b = ask_model("anthropic/claude-opus-4", "Pythonの非同期処理を説明して")

result_c = ask_model("gemini/gemini-2.0-pro", "Pythonの非同期処理を説明して")ここで非自明なのはfallbacksパラメータだ。 gpt-4oがレート制限やダウンタイムで失敗した場合、LiteLLMは自動的にAnthropicへフォールバックし、それも失敗すればGeminiへ移る。この3つのAPI契約・3つのエラーハンドリング・3つのレスポンスパーサーを、開発者が自前で実装する必要がなくなる。

Unified Platformが「向かない」ケース

正直に言う。すべての開発者にとってのベストアンサーではない。

使うべきでないケース

1. 単一モデルに深く依存するプロダクト GPT-4oのfunction callingの特定の挙動や、Claude 3.5のtool useの実装詳細に依存しているなら、抽象化層が邪魔になる可能性がある。プラットフォームの翻訳レイヤーで微妙な挙動が失われることがある。

2. 超低レイテンシーが必要なリアルタイムアプリケーション Unified Platformは必然的に1〜5msの追加レイテンシーを発生させる(クラウドホスト型の場合はさらに増える可能性)。音声AIや高頻度のストリーミングアプリでは許容できない場合がある。

3. 規制上のデータ主権要件が厳しい環境 データが特定の地理的リージョンを出てはならない場合、クラウドホスト型のUnified Platformは即座に失格になる。セルフホスト型(LiteLLMのLocal Mode等)は選択肢になるが、保守コストが発生する。

4. 月間使用量が非常に少ない個人プロジェクト 月間トークン数が数百万未満で、1つのプロバイダーで十分なら、Unified Platformの学習コストと設定オーバーヘッドは割に合わない。

よくある誤解と落とし穴

誤解1:「Unified PlatformはただのAPIプロキシだ」

プロキシはトラフィックを転送するだけだ。Unified Platformはルーティングロジック・コスト管理・可観測性・フォールバック処理を含む。この区別は、ベンダー選定時に重要になる。

誤解2:「モデルの能力が均質化される」

Unified Platformはインターフェースを統一するのであって、モデルの能力を均質化するわけではない。Claude 3.5とGPT-4o-miniは、同じAPIフォーマットで呼び出せても、出力品質は大きく異なる。ルーティング設定を誤ると、コスト削減の代わりに品質低下を招く。

誤解3:「セットアップは一度やれば終わり」

Cost-based routingを有効にした場合、モデルの価格は頻繁に変動する。2024〜2026年にかけて、主要モデルの価格は複数回改定された。ルーティングルールが古くなると、意図しないモデルに大量のトラフィックが流れることがある。定期的な設定レビューが必要だ。

誤解4:「すべてのUnified Platformが同じAPIスキーマを使う」

unified.toが明確に述べているように、プラットフォーム間でアーキテクチャとデータハンドリングは大きく異なる。あるプラットフォームから別のプラットフォームへの移行も、それなりの作業を伴う。ベンダーロックインをゼロにできるわけではない。

移行判断のチェックリスト

Unified Platformへの移行を検討する前に、以下を確認する:

- 現在2つ以上のAIプロバイダーを使っているか、または近い将来使う予定があるか

- モデルの切り替えにコード変更が必要で、それがボトルネックになっているか

- AIコストの予測と管理に困っているか

- プロバイダーのダウンタイムがサービスに直接影響しているか

- チームがAIインフラの保守ではなくプロダクト開発に集中したいか

2つ以上にチェックが入るなら、移行を具体的に検討する価値がある。1つ以下なら、現状の構成で十分な可能性が高い。

まとめ

Unified AI API Platformは、複数AIプロバイダーの管理コストと複雑性を解消するための実用的な解答であり、2026年のコスト危機を背景に採用が加速している。最大80%のコスト削減という数字は、動的ルーティングとフォールバック機能の組み合わせによって実現されるものであり、単なるプロキシ化による効果ではない。ただし、超低レイテンシー要件・強いデータ主権規制・単一モデルへの深い依存がある場合は、導入メリットよりもトレードオフが大きくなる点を忘れてはならない。

メモ: 複数の AI モデルを一つのパイプラインで使う場合、AtlasCloud は Kling、Flux、Seedance、Claude、GPT など 300+ モデルへの統一 API アクセスを提供します。API キー一つで全モデル対応。新規ユーザーは初回チャージで 25% ボーナス(最大 $100)。

AtlasCloudでこのAPIを試す

AtlasCloudよくある質問

Unified AI API Platformを使うと具体的にどのくらいコストが削減できますか?

2026年時点の報告では、主要なUnified AI API Platformを活用することで最大80%のコスト削減が実現されるケースがあります(Commercial Appeal, 2026)。例えば、OpenAI GPT-4oの入力トークン単価が$2.50/1Mトークンであるのに対し、Unified Platform経由でモデルをMistral Large($2.00/1Mトークン)やGemini 1.5 Pro($1.25/1Mトークン)に動的に切り替えることで、ワークロードによっては月間APIコストを数十万円単位で圧縮できます。また、複数プロバイダーの個別サブスクリプション(1契約あたり月額$20〜$500超)を一本化することで、管理コストも含めた総所有コスト(TCO)の削減効果が報告されています。

Unified AI API Platformを経由すると、直接APIを叩くより遅延(レイテンシ)は増えますか?

主要なUnified AI API Platform(例:ai.ccやOpenRouterなど)では、プロキシ層で追加される遅延はおおむね10〜50ms程度とされており、実用上の影響は軽微です。例えばOpenRouterの公開ベンチマークでは、GPT-4o直接呼び出しのTime To First Token(TTFT)が平均約620msであるのに対し、同プラットフォーム経由では約660〜680ms(+約40〜60ms)という計測値が報告されています。ストリーミングレスポンスを活用すれば体感レイテンシはさらに抑えられるため、チャットボットやリアルタイム補完などのユースケースでも許容範囲内と評価する開発チームが多数います。ただし、エッジケースとして同時リクエスト数が急増した際のスループット低下には注意が必要です。

Unified AI API Platformに移行する際、既存のOpenAI SDK向けコードはどのくらい書き直しが必要ですか?

多くのUnified AI API PlatformはOpenAI互換エンドポイントを提供しているため、コード変更はほぼゼロに近いケースが大半です。具体的には、変更箇所はbaseURLを自社APIエンドポイントから各Platformのエンドポイント(例:https://openrouter.ai/api/v1)に書き換えるだけ(1〜2行)で済むことが多く、モデル名の文字列(例:'gpt-4o'→'anthropic/claude-3.5-sonnet')を変えるだけでプロバイダー切り替えが完了します。DIMA AIの調査では、既存OpenAI SDKからの移行作業は平均2〜4時間で完了したと報告されており、5つ以上の個別SDKを保守していたチームでは保守工数を週あたり平均3〜5時間削減できたという事例もあります。

Unified AI API Platformは信頼性(可用性・フェイルオーバー)の面でどう評価されていますか?

主要なUnified AI API Platformは、複数プロバイダーへの自動フェイルオーバーを内蔵しているため、単一プロバイダー直接接続より可用性が高くなるケースが一般的です。例えばOpenAIの2024〜2025年の障害履歴ではSLAが月間99.9%(許容ダウンタイム約43.8分/月)を下回るインシデントが複数報告されましたが、Unified Platform経由ではプライマリモデル障害時にAnthropicやGeminiへ自動切り替えすることで実効可用性99.95%以上を維持した事例が報告されています。コスト面でも、フェイルオーバー先モデルの選定ロジックをコスト優先・レイテンシ優先・品質優先で設定できるプラットフォームが増えており、エンタープライズ向けプランでは月額$500〜$2,000程度でSLA保証付きサービスが提供されています。

タグ

関連記事

Seedance 2.0 API統合ガイド:PythonでテキストからAI動画生成

Seedance 2.0 APIをPythonで活用するための完全ガイド。テキストから高品質な動画を生成する手順、認証設定、コード例を詳しく解説します。初心者から上級者まで対応。

DeepSeek API企業導入ガイド2026|コンプライアンス・SLA・コスト完全解説

DeepSeek APIの企業導入に必要なコンプライアンス要件、SLA条件、コスト最適化戦略を徹底解説。2026年版の最新情報をもとに、安全で効率的なAPI活用方法をわかりやすくご紹介します。

SOC2・HIPAA準拠AIAPIガイド|エンタープライズ開発者必見

エンタープライズ開発者向けにSOC2とHIPAA準拠のAI APIを徹底解説。セキュリティ要件、実装手順、コンプライアンス対応のベストプラクティスを詳しく紹介します。