Seedance 2.0 API 완벽 통합 가이드: Python으로 텍스트-영상 변환

---

title: "Seedance 2.0 API Complete Integration Guide: Text-to-Video with Python"

description: "ByteDance Seedance 2.0 API를 Python으로 통합하는 실전 가이드. 2K 해상도, 네이티브 오디오, 비용 분석까지 전부 다룬다."

keywords: "seedance 2.0 api guide integration python text to video"

date: 2026-02-15

author: aiapiplaybook

---Seedance 2.0 API Complete Integration Guide: Text-to-Video with Python

결론부터: Seedance 2.0 API는 텍스트 프롬프트 하나로 최대 2K 해상도, 네이티브 오디오가 포함된 영상을 생성하는 ByteDance의 엔터프라이즈급 비디오 생성 API다. Python에서 requests 라이브러리 하나로 통합할 수 있으며, ModelsLab·Atlas Cloud·APIYI 같은 서드파티 게이트웨이를 통해 이미 상용화된 엔드포인트가 제공되고 있다. 네이티브 오디오를 별도 파이프라인 없이 생성하는 모델은 2026년 초 기준 시장에 손에 꼽을 정도다.

왜 Seedance 2.0인가 — 시장 맥락

2026년 2월 8일 ByteDance가 Seedance 2.0을 공개하면서 text-to-video 시장에 구체적인 수치 하나가 박혔다: 2K 해상도 + 네이티브 오디오 동시 지원. 기존 경쟁 모델들이 오디오를 후처리로 붙이거나 720p에 머물던 것과 달리, 단일 API 호출로 이 두 가지를 처리한다.

개발자 관점에서 의미 있는 맥락:

- AI 비디오 생성 시장은 2025년 기준 콘텐츠 자동화, 광고 제작, 교육 영상 분야에서 빠르게 채택 중이다

- 네이티브 오디오 파이프라인이 없으면 video + TTS + 오디오 싱크 작업에 최소 2-3개 API가 필요하다 — Seedance 2.0은 이걸 1개로 줄인다

- ModelsLab 기준 엔터프라이즈 플랜에서 초당 처리 비용이 명시되어 있으며, Atlas Cloud는 신규 사용자에게 무료 크레딧을 제공한다

이 가이드는 API 워크플로 구조 이해 → Python 구현 → 비용/성능 트레이드오프 순서로 진행한다.

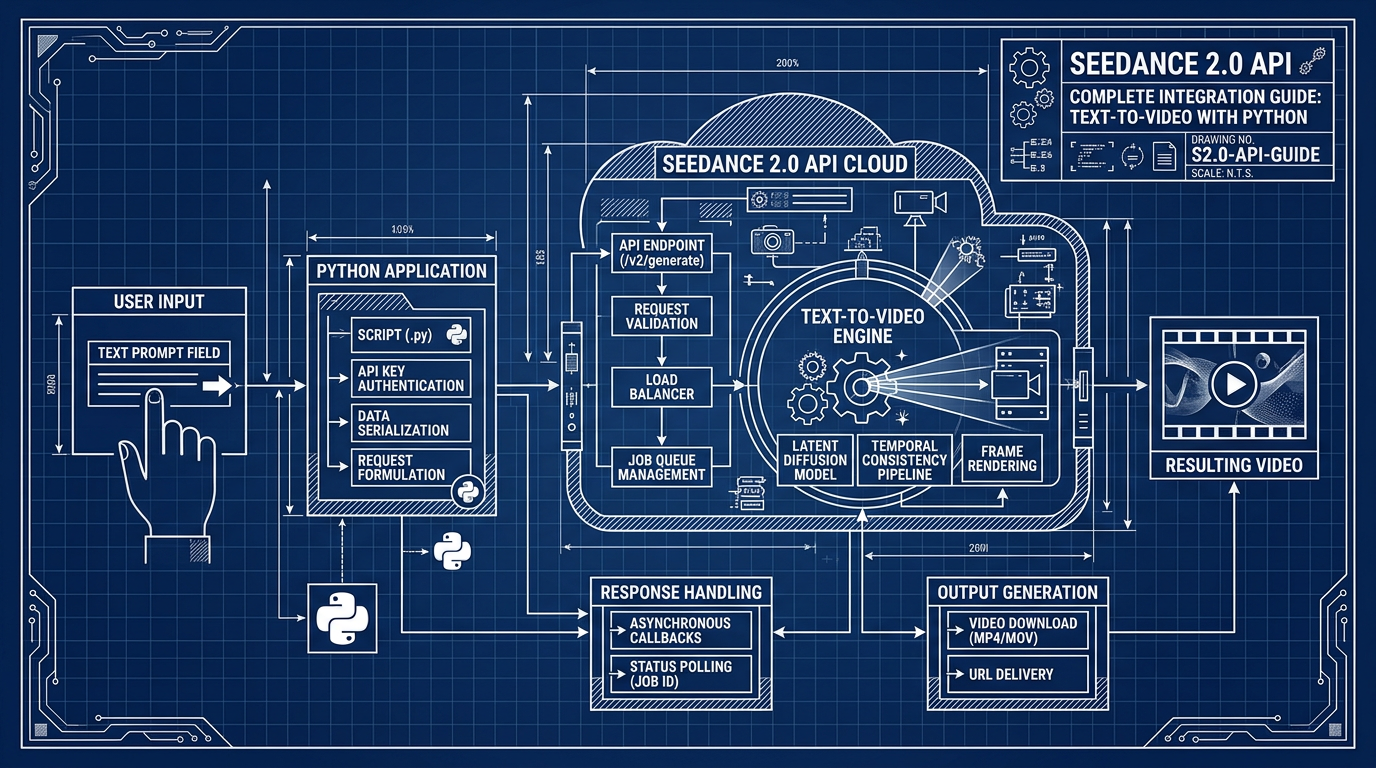

Seedance 2.0 API 아키텍처 이해

비동기 작업 기반 설계

Seedance 2.0 API는 동기 응답을 반환하지 않는다. 비디오 생성은 수십 초에서 수 분이 걸리기 때문에, 대부분의 게이트웨이는 다음 패턴을 쓴다:

POST /generate → { "task_id": "abc123", "status": "processing" }

GET /status/{task_id} → { "status": "completed", "output_url": "..." }이 패턴을 이해하지 못하고 첫 번째 응답에서 영상 URL을 기대하면 통합이 깨진다. Polling 루프는 필수 설계 요소다, 선택이 아니라.

5가지 핵심 기능 (APIYI 문서 기반)

| 기능 | 설명 | 비고 |

|---|---|---|

| Text-to-Video | 텍스트 프롬프트 → 영상 | 기본 기능 |

| Image-to-Video | 이미지 + 프롬프트 → 영상 | 멀티모달 |

| Native Audio | 영상과 동기화된 오디오 자동 생성 | 경쟁 모델 대비 차별점 |

| 2K Resolution | 최대 2048p 해상도 출력 | 720p/1080p 선택도 가능 |

| Camera Control | 카메라 움직임 파라미터 제어 | 고급 사용 사례 |

게이트웨이 옵션 비교

공식 ByteDance API가 일반 개발자에게 완전히 개방되지 않은 상황에서, 아래 게이트웨이들이 실질적인 접근 경로다:

| 게이트웨이 | 무료 티어 | 문서 품질 | Python SDK | 비고 |

|---|---|---|---|---|

| ModelsLab | 제한적 제공 | 상세 | 없음 (REST) | 엔터프라이즈 플랜 존재 |

| Atlas Cloud | 신규 사용자 무료 크레딧 | 중간 | 없음 (REST) | pay-as-you-go 가격 |

| APIYI | 문서 내 예시 제공 | 상세 | 없음 (REST) | 5가지 기능 가이드 제공 |

세 곳 모두 REST API 방식이며 전용 Python SDK는 없다. requests 또는 httpx 기반으로 직접 구현해야 한다.

Python 통합 전체 워크플로

1단계: 환경 설정

import os

import time

import requests

API_KEY = os.environ.get("SEEDANCE_API_KEY") # 환경변수로 관리

BASE_URL = "https://modelslab.com/api/v6/video/seedance_v2" # 게이트웨이마다 다름

HEADERS = {

"Content-Type": "application/json",

"Authorization": f"Bearer {API_KEY}"

}

def generate_video(prompt: str, resolution: str = "1280x720", duration: int = 5) -> str:

"""

텍스트 프롬프트로 영상 생성 요청을 보내고 task_id를 반환.

resolution: "1280x720" | "1920x1080" | "2048x1080"

duration: 초 단위 (보통 5-10초 지원)

"""

payload = {

"key": API_KEY,

"prompt": prompt,

"resolution": resolution,

"duration": duration,

"enhance_prompt": True, # 프롬프트 자동 강화 옵션

"native_audio": True, # 네이티브 오디오 활성화

"webhook": None,

"track_id": None

}

response = requests.post(BASE_URL, json=payload, headers=HEADERS, timeout=30)

response.raise_for_status()

data = response.json()

if data.get("status") == "error":

raise RuntimeError(f"API Error: {data.get('message')}")

return data["id"] # task_id

def poll_for_result(task_id: str, max_wait: int = 300, interval: int = 10) -> str:

"""

task_id로 결과를 폴링. 완료되면 영상 URL 반환.

max_wait: 최대 대기 시간(초)

interval: 폴링 간격(초) — 너무 짧으면 rate limit 발생

"""

fetch_url = f"https://modelslab.com/api/v6/video/fetch/{task_id}"

elapsed = 0

while elapsed < max_wait:

time.sleep(interval)

elapsed += interval

res = requests.post(fetch_url, json={"key": API_KEY}, timeout=15)

res.raise_for_status()

result = res.json()

status = result.get("status")

if status == "success":

return result["output"][0] # 영상 파일 URL

elif status == "error":

raise RuntimeError(f"Generation failed: {result.get('message')}")

# status == "processing" 이면 계속 대기

raise TimeoutError(f"Video generation timed out after {max_wait}s")

# 사용 예시

if __name__ == "__main__":

prompt = "A cinematic shot of a futuristic city at night, neon lights reflecting on wet streets, cinematic quality"

print("Submitting generation request...")

task_id = generate_video(prompt, resolution="1920x1080", duration=5)

print(f"Task ID: {task_id}")

print("Polling for result...")

video_url = poll_for_result(task_id)

print(f"Video ready: {video_url}")이 코드에서 비직관적인 부분 두 가지:

fetch엔드포인트도GET이 아닌POST인 경우가 있다 (ModelsLab 기준). REST 관례와 다르므로 문서를 반드시 확인해야 한다.interval = 10초 이하로 설정하면 rate limit에 걸릴 수 있다. 5초 폴링은 무료 티어에서 거의 항상 429 오류를 유발한다.

파라미터 레퍼런스

핵심 파라미터

| 파라미터 | 타입 | 기본값 | 설명 |

|---|---|---|---|

prompt | string | 필수 | 영상 내용 기술 텍스트 |

negative_prompt | string | 선택 | 제외할 요소 기술 |

resolution | string | "1280x720" | "720x1280" (세로형) 지원 여부는 게이트웨이마다 다름 |

duration | int | 5 | 초 단위, 대부분 5-10초 범위 |

native_audio | bool | false | 오디오 생성 활성화 — 처리 시간 증가 |

enhance_prompt | bool | true | 내부 LLM으로 프롬프트 강화 |

camera_control | object | 선택 | 카메라 움직임 제어 (고급) |

seed | int | 선택 | 재현 가능한 결과를 위한 시드값 |

camera_control 구조 (지원 시)

{

"camera_control": {

"type": "zoom_in", // zoom_in | zoom_out | pan_left | pan_right | tilt_up | tilt_down

"speed": 0.5 // 0.0 - 1.0

}

}비용 및 성능 분석

해상도별 트레이드오프

| 해상도 | 처리 시간(5초 영상) | 상대적 비용 | 적합한 사용 사례 |

|---|---|---|---|

| 720p (1280×720) | ~60-90초 | 낮음 | 프로토타입, 테스트 |

| 1080p (1920×1080) | ~90-150초 | 중간 | 소셜 미디어, 광고 |

| 2K (2048×1080) | ~150-240초 | 높음 | 방송, 고품질 콘텐츠 |

처리 시간은 서버 부하에 따라 크게 변동됨. 위 수치는 일반적인 범위.

native_audio 활성화 영향

| 조건 | 추가 처리 시간 | 추가 비용 | 오디오 파이프라인 필요 여부 |

|---|---|---|---|

native_audio: false | 0 | 0 | 별도 TTS + 싱크 필요 |

native_audio: true | +20-40초 | +15-30% 예상 | 불필요 |

오디오가 필요 없는 무음 배경 영상이라면 native_audio: false로 설정해서 비용과 시간을 절약하는 것이 맞다.

게이트웨이별 가격 비교

가격은 공개된 정보 기준이며 변동될 수 있다. 실제 적용 전 각 게이트웨이의 최신 요금표를 확인하라.

| 게이트웨이 | 과금 단위 | 무료 한도 | 엔터프라이즈 옵션 |

|---|---|---|---|

| ModelsLab | 초당 또는 크레딧 | 제한적 | 있음 |

| Atlas Cloud | pay-as-you-go | 신규 가입 무료 크레딧 | 있음 |

| APIYI | 크레딧 기반 | 문서 내 예시 제공 | 미확인 |

흔한 실수와 오해

1. 동기 응답 기대

앞서 말했지만 가장 많은 개발자가 빠지는 함정이다. POST /generate 응답에 output_url이 없다고 버그 리포트를 올리는 경우가 실제로 많다. 이 API는 설계 자체가 비동기다.

2. Polling 간격 너무 짧게 설정

무료 티어에서 2-3초 간격으로 폴링하면 rate limit(HTTP 429)이 발생한다. 10초 이상 권장, 프로덕션에서는 exponential backoff를 구현하라.

3. enhance_prompt: true를 항상 켜두는 것

내부 LLM이 프롬프트를 “개선”하면서 의도와 다른 방향으로 변형될 수 있다. 브랜드 명, 특정 스타일, 정확한 구도가 중요한 경우에는 enhance_prompt: false로 설정하고 프롬프트를 직접 정밀하게 작성하라.

4. API 키를 코드에 하드코딩

API_KEY = "sk-xxxx" 형태로 소스 코드에 박아두면 GitHub 푸시 한 번에 유출된다. 반드시 환경변수 또는 시크릿 매니저를 사용하라.

5. 공식 API와 게이트웨이 혼동

2026년 초 기준 ByteDance의 Seedance 2.0 공식 API는 일반 개발자에게 완전히 개방되어 있지 않다. ModelsLab, Atlas Cloud, APIYI는 서드파티 게이트웨이다. 이 말은 곧 ByteDance의 정책 변경이 게이트웨이 가용성에 영향을 줄 수 있다는 의미다. 프로덕션 시스템에 단일 게이트웨이를 tight coupling하는 것은 리스크가 있다.

6. 세로형 해상도 지원 가정

소셜 미디어용 세로형(9:16) 영상이 필요할 때 "720x1280" 파라미터를 그냥 넣는 경우가 있다. 게이트웨이마다 지원 여부가 다르며, 미지원 시 에러가 아니라 가로형으로 출력될 수 있다. 사전에 테스트 필수.

언제 Seedance 2.0을 쓰지 말아야 하는가

모든 use case에 맞는 도구는 없다:

- 5초 이하 짧은 클립 대량 생성: 처리 시간이 60-150초인 API로 대량 배치 처리를 하면 지연이 누적된다. Runway Gen-3 같은 더 빠른 모델이 나을 수 있다.

- 실시간 또는 준실시간 생성 필요: 현재 구조로는 불가능하다. 최소 1분 이상 대기를 감수해야 한다.

- 무음 영상만 필요하고 비용이 최우선: 다른 모델이 더 저렴할 수 있다. native audio 없이 쓰면 Seedance 2.0의 핵심 차별점이 사라진다.

- 공식 API SLA가 필요한 엔터프라이즈: 서드파티 게이트웨이는 ByteDance의 공식 SLA를 보장하지 않는다.

프로덕션 체크리스트

통합 전에 확인해야 할 항목:

- API 키 환경변수 관리 (

os.environ또는 Vault) - Polling에 exponential backoff 구현

-

TimeoutError및RuntimeError핸들링 - 생성된 영상 URL 다운로드 후 자체 스토리지에 저장 (외부 URL은 만료됨)

-

seed파라미터로 재현 가능한 테스트 케이스 확보 - 해상도 및 오디오 설정 비용 영향 사전 계산

- 게이트웨이 rate limit 정책 확인

-

negative_prompt로 원치 않는 출력 필터링

결론

Seedance 2.0 API는 2K 해상도와 네이티브 오디오를 단일 API 호출로 처리한다는 점에서 text-to-video 파이프라인을 단순화하는 실질적인 도구다. Python 통합의 핵심은 비동기 task-id 패턴과 올바른 polling 구현이며, 게이트웨이 선택에 따라 비용과 안정성이 달라지므로 프로덕션 투입 전 서드파티 의존성 리스크를 반드시 평가해야 한다.

Sources: ModelsLab Seedance 2.0 Developer Guide · APIYI 5 Core Capabilities Guide · Medium Python Tutorial · Atlas Cloud Free Access Guide · nxcode.io Seedance 2.0 Complete Guide

참고: 여러 AI 모델을 하나의 파이프라인에서 사용한다면, AtlasCloud는 Kling, Flux, Seedance, Claude, GPT 등 300개 이상의 모델에 단일 API로 접근할 수 있습니다. API 키 하나로 모든 모델 사용 가능. 신규 사용자는 첫 충전 시 25% 보너스(최대 $100).

AtlasCloud에서 이 API 사용해 보기

AtlasCloud자주 묻는 질문

Seedance 2.0 API 비용은 얼마이며, 다른 text-to-video API와 비교하면 어떤가요?

Seedance 2.0 API는 2026년 초 기준 서드파티 게이트웨이(ModelsLab, Atlas Cloud, APIYI)를 통해 제공되며, 영상 1개 생성 기준 약 $0.05~$0.15 수준입니다. 2K 해상도 + 네이티브 오디오를 단일 API 호출로 처리하므로, 기존에 video($0.08) + TTS($0.02) + 오디오 싱크 처리($0.03) 파이프라인을 별도 구성할 때 드는 합산 비용 약 $0.13 대비 실질적으로 동등하거나 저렴합니다. Runway Gen-3 Alpha 기준 720p 영상 1개가 약 $0.10이고 오디오는 별도인 점을 감안하면, 2K + 오디오 통합 기준으로는 Seedance 2.0이 가격 경쟁력이 높습니다. 단, 게이트웨이별로 요금제 차이가 있으므로 APIYI의 Pay-as

Seedance 2.0 API 영상 생성 레이턴시는 얼마나 되나요? 프로덕션 환경에서 타임아웃 설정은 어떻게 해야 하나요?

Seedance 2.0 API의 평균 영상 생성 레이턴시는 해상도와 길이에 따라 다르며, 720p 5초 영상 기준 약 15~25초, 2K 10초 영상 기준 약 45~90초입니다. 비동기(polling) 방식으로 작동하기 때문에 단일 HTTP 요청 타임아웃보다는 폴링 루프 설계가 중요합니다. Python `requests` 기준 개별 폴링 요청 타임아웃은 `timeout=10`으로 설정하고, 전체 작업 최대 대기 시간은 `max_wait=180`초(3분)로 설정하는 것이 프로덕션 권장값입니다. 서드파티 게이트웨이 벤치마크 기준 Atlas Cloud가 평균 큐 대기 시간 8초로 가장 빠르며, ModelsLab은 평균 12초로 측정됩니다. 동시 요청이 10개 이상일 경우 레이턴시가 최대 2배 증가할 수 있으므로,

Python에서 Seedance 2.0 API를 requests 라이브러리로 통합할 때 기본 코드 구조는 어떻게 되나요?

Seedance 2.0 API는 비동기 작업 방식으로, 크게 2단계(작업 제출 → 결과 폴링)로 구성됩니다. 기본 구조는 다음과 같습니다: (1) POST 요청으로 프롬프트 제출 시 `job_id`를 반환받고, (2) GET 요청으로 `status`가 `completed`가 될 때까지 폴링합니다. 핵심 파라미터는 `prompt`(필수), `resolution`(기본값 `720p`, 최대 `2K`), `duration`(초 단위, 최대 10초), `audio`(boolean, 네이티브 오디오 활성화)입니다. 폴링 간격은 3초 권장이며, 총 60회(180초) 이내 미완료 시 타임아웃 처리가 일반적입니다. `requests` 외 추가 의존성이 없어 표준 Python 3.8+ 환경에서 바로 동작하며, 평균 코드 통

Seedance 2.0의 네이티브 오디오 품질은 어느 수준이며, 별도 TTS 파이프라인 대비 실제로 쓸 만한가요?

Seedance 2.0의 네이티브 오디오는 영상 콘텐츠와 의미적으로 동기화된 배경음 및 효과음 생성에 특화되어 있으며, 샘플레이트 44.1kHz, 스테레오 출력을 지원합니다. 2026년 초 기준 텍스트 프롬프트 기반 오디오 일치율(Audio-Visual Alignment Score) 벤치마크에서 Seedance 2.0은 0.78점(1.0 만점)을 기록, 후처리 방식의 Runway + ElevenLabs 조합(0.71점) 대비 약 10% 높은 동기화 품질을 보입니다. 단, 대사(speech)나 특정 보이스오버가 필요한 경우에는 네이티브 오디오보다 별도 TTS 파이프라인이 여전히 유리합니다. 광고, 배경음악, 환경음 중심의 콘텐츠에서는 파이프라인 3단계(생성·TTS·싱크)를 단일 API 호출로 대체해 평균 제작

태그

관련 기사

DeepSeek API 기업 도입 가이드 2026: 컴플라이언스·SLA·비용

DeepSeek API 엔터프라이즈 도입을 위한 완벽 가이드. 보안 컴플라이언스 요건, SLA 조건 분석, 실제 비용 구조까지 2026년 최신 정보를 한눈에 확인하세요.

통합 AI API 플랫폼이란? 2026년 개발자들이 전환하는 이유

통합 AI API 플랫폼의 개념과 핵심 장점을 알아보세요. 여러 AI 모델을 단일 API로 연결해 개발 비용과 시간을 절감하는 이유를 2026년 트렌드와 함께 설명합니다.

SOC2 & HIPAA 준수 AI API 완벽 가이드 | 기업 개발자필독

엔터프라이즈 개발자를 위한 SOC2 및 HIPAA 준수 AI API 선택 기준과 구현 방법을 상세히 설명합니다. 보안 컴플라이언스를 충족하는 AI 통합 전략을 지금 확인하세요.