통합 AI API 플랫폼이란? 2026년 개발자들이 전환하는 이유

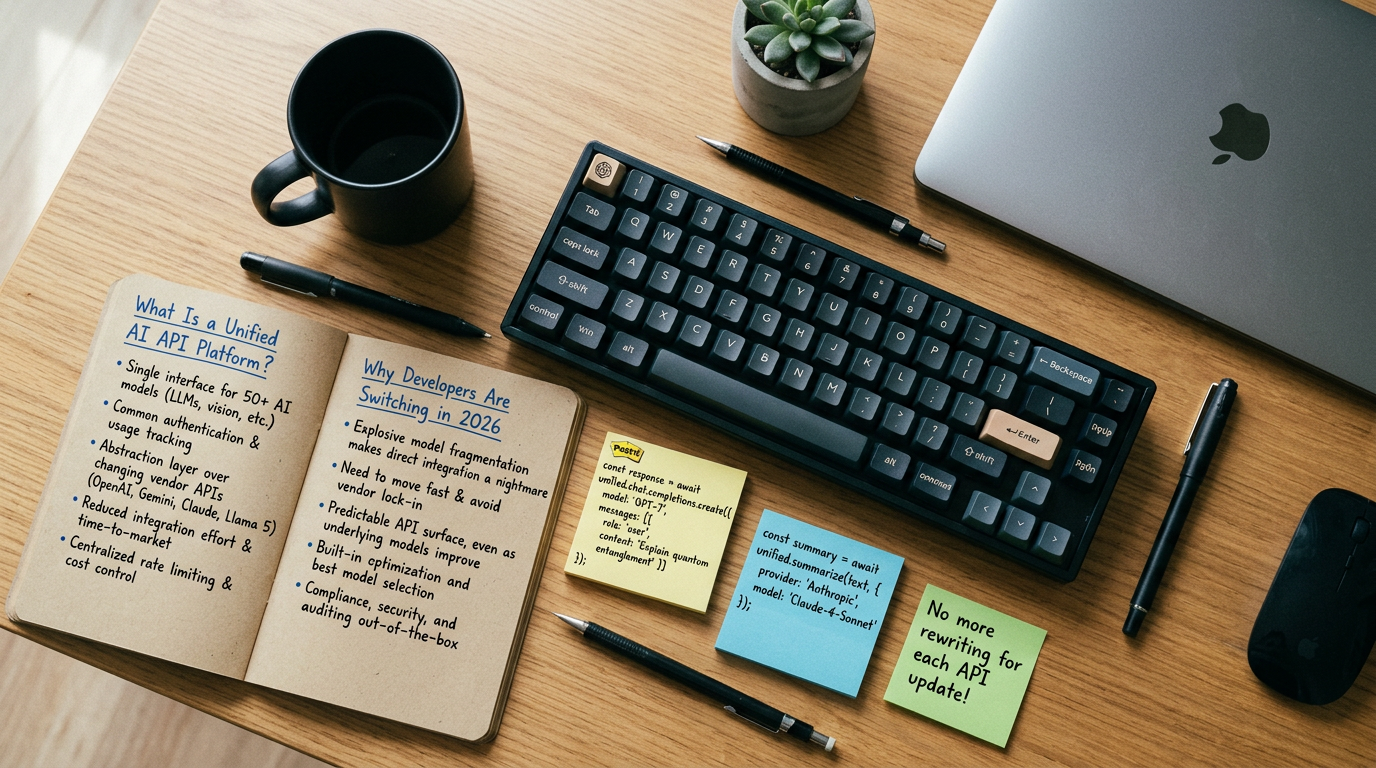

Unified AI API Platform이란 무엇인가? 2026년 개발자들이 전환하는 이유

Unified AI API Platform은 단일 인터페이스로 OpenAI, Anthropic, Google Gemini, Mistral 등 여러 AI 모델 공급자에 접근할 수 있게 해주는 추상화 계층이다. 2026년 현재, AI API 통합 플랫폼 도입 기업의 사례 연구에 따르면 운영 비용 최대 80% 절감이 보고되고 있으며(Commercial Appeal, 2026), 5개의 개별 AI 구독을 관리하던 시대는 빠르게 끝나가고 있다(DIMA AI, 2026).

왜 지금인가: 2026년 AI API 파편화 문제

2023~2025년 사이, 대부분의 개발팀은 모델별 API를 직접 연결하는 방식으로 AI를 통합했다. OpenAI용 SDK, Anthropic용 SDK, Google Vertex AI용 클라이언트를 각각 유지하는 것이 기본 패턴이었다.

이 방식이 가져온 실질적 문제는 다음과 같다:

- 코드 중복: 모델마다 다른 요청/응답 스키마, 에러 처리 로직, 재시도 패턴

- 비용 가시성 부재: 여러 공급자에 분산된 지출을 한 곳에서 추적하기 어려움

- 모델 락인(lock-in): GPT-4에서 Claude 3.5로 전환하려면 상당한 코드 수정 필요

- 운영 오버헤드: API 키 관리, rate limit 핸들링, fallback 로직을 각 공급자별로 구현

2026년 기준으로 엔터프라이즈 AI 도입 팀이 평균 3.7개의 서로 다른 LLM 공급자를 동시에 사용한다는 점을 감안하면, 이 파편화 문제의 규모가 체감된다. Unified API는 이 복잡성을 단일 엔드포인트 뒤로 숨긴다.

Unified AI API Platform의 정확한 정의

AICC의 2026년 정의에 따르면:

“A Unified AI API is a single application programming interface that provides standardized access to multiple AI models and providers, allowing developers to switch models, manage usage, and control costs without changing application code.”

핵심은 마지막 구절이다: 코드를 바꾸지 않고 모델을 전환한다. 단순한 편의 기능이 아니라, 아키텍처 수준의 결정이다.

Unified AI API가 하는 일 (기술적 관점)

| 기능 | 설명 |

|---|---|

| Request normalization | 각 공급자의 다른 요청 포맷을 단일 스키마로 변환 |

| Response normalization | 모델마다 다른 응답 구조를 표준화된 객체로 통일 |

| Model routing | 비용, 성능, 가용성 기준으로 최적 모델 자동 선택 |

| Fallback handling | 주 모델 장애 시 대체 모델로 자동 전환 |

| Usage aggregation | 여러 공급자의 토큰 사용량, 비용을 단일 대시보드에서 추적 |

| Rate limit management | 공급자별 rate limit을 플랫폼 레벨에서 처리 |

| Caching | 동일하거나 유사한 요청에 대한 응답 캐싱으로 비용 절감 |

Unified AI API가 아닌 것

혼동을 피하기 위해 명확히 해두자:

- AI 오케스트레이션 프레임워크(LangChain, LlamaIndex): 이것들은 체이닝, RAG, 에이전트 로직을 다루는 레이어다. Unified API와 함께 쓸 수 있지만, 같은 것이 아니다.

- 단순 API 게이트웨이: Kong, AWS API Gateway 같은 범용 게이트웨이는 AI 특화 기능(모델 비교, 토큰 비용 계산 등)이 없다.

- 멀티모달 단일 모델: GPT-4o처럼 이미지·텍스트를 모두 처리하는 모델은 Unified API가 아니다. 여전히 단일 공급자에 종속된다.

2026년 주요 Unified AI API 플랫폼 비교

Unified.to의 2026년 분석이 명확히 지적하듯, “unified API”라는 레이블을 붙인 플랫폼들은 아키텍처, 데이터 처리, 가격 정책, 운영 성숙도에서 편차가 매우 크다. 레이블만 보고 선택하면 안 된다.

아래는 2026년 현재 활발히 사용되는 플랫폼들의 주요 특성을 정리한 표다:

| 플랫폼 | 지원 공급자 수 | 자체 호스팅 | 캐싱 | 시맨틱 라우팅 | 가격 모델 |

|---|---|---|---|---|---|

| OpenRouter | 100+ | ❌ | ✅ | ✅ | 사용량 기반 |

| LiteLLM | 100+ | ✅ | ✅ | ✅ | 오픈소스 (self-hosted) |

| Portkey | 50+ | 부분 지원 | ✅ | ✅ | 요청 수 기반 |

| Helicone | 30+ | ✅ | ✅ | ❌ | 요청 수 기반 |

| AI Gateway (Cloudflare) | 20+ | ❌ (엣지) | ✅ | ❌ | 사용량 기반 |

| Azure AI Foundry | 15+ | ❌ | 제한적 | ✅ | Azure 종량제 |

참고: 지원 공급자 수는 각 플랫폼의 2026년 1분기 공식 문서 기준이며, 실험적(experimental) 통합은 제외했다.

선택 기준: 어떤 플랫폼을 언제 써야 하는가

| 시나리오 | 권장 선택 | 이유 |

|---|---|---|

| 스타트업, 빠른 프로토타이핑 | OpenRouter | 설정 없이 즉시 사용, 100+ 모델 접근 |

| 데이터 컴플라이언스 필요 (HIPAA, GDPR) | LiteLLM self-hosted | 데이터가 외부로 나가지 않음 |

| 엔터프라이즈, 기존 Azure 스택 | Azure AI Foundry | IAM, 감사 로그, 청구 통합 |

| 엣지/CDN 통합 | Cloudflare AI Gateway | 레이턴시 최소화, 글로벌 분산 |

| 세밀한 옵저버빌리티 필요 | Portkey 또는 Helicone | 요청 로깅, A/B 테스트, 비용 분석 |

핵심 아키텍처 패턴: 어떻게 작동하는가

패턴 1: Proxy 방식

가장 일반적인 구현이다. 클라이언트는 Unified API 엔드포인트로 요청을 보내고, 플랫폼이 이를 적절한 공급자 API로 변환하여 전달한다.

Client → Unified API Proxy → [OpenAI / Anthropic / Gemini / ...]요청 포맷은 대부분 OpenAI의 Chat Completions 스키마를 표준으로 채택하고 있다. 이는 업계 사실상 표준(de facto standard)이 됐다.

패턴 2: SDK 추상화 방식

LiteLLM처럼 Python/JavaScript SDK 레이어에서 추상화를 제공하는 방식이다. 프록시 서버 없이 코드 레벨에서 공급자를 전환할 수 있다.

아래 코드는 이 패턴의 핵심을 보여준다:

import litellm

# 이 단일 함수 호출로 아래 모든 모델을 동일한 방식으로 호출 가능

# model만 바꾸면 된다 — 요청/응답 처리 코드는 전혀 수정 불필요

response = litellm.completion(

model="gpt-4o", # 또는 "claude-3-5-sonnet", "gemini/gemini-1.5-pro"

messages=[{"role": "user", "content": "Explain transformer architecture"}],

max_tokens=500,

# fallbacks: 주 모델 실패 시 자동 전환

fallbacks=["claude-3-5-haiku", "gemini/gemini-1.5-flash"],

# metadata: 비용 추적용

metadata={"project": "search-feature", "team": "platform"}

)

# 응답 구조는 모델에 관계없이 동일

print(response.choices[0].message.content)

print(f"Total cost: ${litellm.completion_cost(response):.6f}")이 코드에서 중요한 점: model 파라미터 값 하나만 바꾸면 OpenAI → Anthropic → Google로 전환된다. fallbacks 파라미터는 주 모델 장애나 rate limit 초과 시 자동으로 대체 모델을 시도한다. 비즈니스 로직은 건드리지 않아도 된다.

패턴 3: 시맨틱 라우팅 (Semantic Routing)

2026년에 차별화 요소로 부상한 기능이다. 단순히 모델을 고정 설정으로 전환하는 것이 아니라, 요청의 내용과 복잡도를 분석해서 가장 비용 효율적인 모델로 자동 라우팅한다.

예시:

- 단순 분류 작업 →

gemini-1.5-flash(저비용) - 복잡한 코드 생성 →

claude-3-5-sonnet(고성능) - 긴 문서 요약 →

gemini-1.5-pro(긴 컨텍스트 윈도우)

이 라우팅 결정을 플랫폼이 자동으로 내려준다.

비용/성능 분석: 실제 숫자

2026년 AI 비용 위기 분석에서 제시된 데이터를 기반으로, Unified API 도입 전후의 일반적인 비용 구조를 비교한다.

시나리오: 월 1,000만 토큰 처리하는 SaaS 제품

| 구성 | 모델 | 입력 비용/1M 토큰 | 출력 비용/1M 토큰 | 월 예상 비용 | 비고 |

|---|---|---|---|---|---|

| 단일 모델 (고정) | GPT-4o | $5.00 | $15.00 | ~$100 | 모든 요청에 동일 모델 사용 |

| Unified API + 라우팅 | 혼합 (Flash/Haiku/GPT-4o) | $0.30~$5.00 | $0.60~$15.00 | 복잡도별 최적 모델 자동 선택 | |

| Unified API + 캐싱 포함 | 혼합 + semantic cache | — | — | 반복 요청 캐시 히트율 30~40% |

비용은 2026년 1분기 각 공급자 공식 가격 기준 추정치이며, 실제 비용은 요청 패턴에 따라 달라진다.

운영 오버헤드 비교

| 지표 | 개별 API 직접 연결 | Unified API 플랫폼 |

|---|---|---|

| 새 모델 통합 시간 | 2~5일 (SDK 업데이트, 테스트) | 설정 변경 수분~수시간 |

| Fallback 로직 구현 | 각 공급자별 개별 구현 필요 | 플랫폼 레벨에서 자동 처리 |

| 비용 모니터링 | 공급자별 대시보드 개별 확인 | 단일 대시보드 |

| API 키 관리 | n개의 키를 각각 rotation | 단일 키 관리 |

| Rate limit 핸들링 | 개발자가 직접 구현 | 자동 처리 |

흔한 오해와 실제 함정

오해 1: “Unified API를 쓰면 모든 모델 기능을 동일하게 쓸 수 있다”

실제: 추상화는 공통 분모에서 동작한다. 특정 모델의 고유 기능(예: Claude의 extended thinking, GPT-4o의 structured outputs의 세부 옵션, Gemini의 grounding 기능)은 표준화된 인터페이스로 완전히 노출되지 않을 수 있다. 모델 고유 기능을 최대한 활용해야 하는 경우에는 해당 공급자 SDK를 직접 사용하는 것이 낫다.

오해 2: “중간 레이어가 생기니 레이턴시가 증가한다”

실제: 플랫폼에 따라 다르다. Proxy 방식은 일반적으로 10~50ms의 추가 레이턴시를 발생시킨다. 그러나 캐싱이 적용된 경우 반복 요청의 응답 시간은 오히려 극적으로 줄어든다. 레이턴시가 극도로 중요한 실시간 음성 응답 애플리케이션 등에서는 trade-off를 명확히 평가해야 한다.

오해 3: “데이터가 추가 서드파티를 통과하니 보안이 약해진다”

실제: 이는 플랫폼 선택의 문제다. Self-hosted LiteLLM이나 Cloudflare AI Gateway처럼 데이터가 외부로 나가지 않는 구성도 가능하다. 단, 클라우드 기반 Unified API SaaS를 사용할 경우 DPA(Data Processing Agreement) 체결, 데이터 잔존 정책, 로그 보존 기간을 반드시 확인해야 한다. HIPAA나 GDPR 적용 대상이라면 self-hosted 또는 엔터프라이즈 계약이 필수다.

오해 4: “벤더 락인 문제가 해결된다”

부분적으로만 맞다. AI 모델 공급자 락인은 줄어든다. 그러나 이제는 Unified API 플랫폼에 대한 락인이 생긴다. 플랫폼이 독점적인 라우팅 설정 포맷, 커스텀 메타데이터 구조, 독자적인 캐싱 정책을 사용한다면 플랫폼 전환도 비용이 든다. 오픈소스(LiteLLM)를 선택하거나, 설정을 코드로 관리(IaC)하는 방식으로 이 리스크를 완화할 수 있다.

오해 5: “모든 팀에 적합하다”

그렇지 않다. 아래 경우에는 Unified API 플랫폼이 오히려 복잡성을 더한다:

| 상황 | 이유 |

|---|---|

| 단일 모델만 사용하는 소규모 프로젝트 | 추상화 레이어의 이점보다 운영 복잡성이 더 클 수 있음 |

| 특정 모델의 고유 기능에 깊이 의존 | 표준화 인터페이스가 기능을 제한할 수 있음 |

| 극단적 저레이턴시 요구 (< 100ms P99) | 프록시 추가 레이턴시가 SLA를 위협할 수 있음 |

| 내부 fine-tuned 모델만 사용 | 외부 공급자 통합 이점 없음 |

실전 도입 체크리스트

Unified AI API 플랫폼 도입을 고려하는 팀을 위한 평가 기준이다:

아키텍처 검토

- 현재 사용 중인 AI 공급자 수와 향후 추가 계획 파악

- 모델 전환 빈도와 그에 드는 엔지니어링 시간 측정

- 레이턴시 SLA 확인 (추가 10~50ms 허용 가능한지)

플랫폼 선택

- 데이터 규정 준수 요건 확인 (self-hosted 필요 여부)

- 필요한 모델이 플랫폼에서 지원되는지 확인

- 시맨틱 라우팅, 캐싱, fallback 기능 지원 여부

- 가격 구조가 예상 사용량과 매칭되는지 계산

마이그레이션

- 기존 직접 연결 코드의 엔드포인트를 플랫폼 엔드포인트로 점진적 전환

- A/B 테스트로 라우팅 전략 검증

- 비용 모니터링 알림 설정

결론

Unified AI API Platform은 단순한 편의 도구가 아니라, 멀티 모델 전략을 실행 가능하게 만드는 아키텍처 결정이다. 개별 모델 공급자에 직접 연결하는 방식은 팀이 1~2개 모델을 쓸 때는 괜찮지만, 모델 포트폴리오가 확장될수록 기하급수적으로 복잡해진다. 단, 데이터 컴플라이언스 요건, 레이턴시 제약, 모델 고유 기능 의존도에 따라 플랫폼 선택과 구성이 달라지므로 레이블이 아닌 아키텍처를 기준으로 평가해야 한다.

이 글의 비용 수치는 2026년 1분기 공개 가격 기준 추정치이며, 실제 환경에서는 요청 패턴, 캐시 히트율, 협상 계약에 따라 달라질 수 있다.

참고: 여러 AI 모델을 하나의 파이프라인에서 사용한다면, AtlasCloud는 Kling, Flux, Seedance, Claude, GPT 등 300개 이상의 모델에 단일 API로 접근할 수 있습니다. API 키 하나로 모든 모델 사용 가능. 신규 사용자는 첫 충전 시 25% 보너스(최대 $100).

AtlasCloud에서 이 API 사용해 보기

AtlasCloud자주 묻는 질문

Unified AI API 플랫폼 사용 시 실제 비용이 얼마나 절감되나요? 구체적인 수치가 궁금합니다.

2026년 상용 사례 연구에 따르면 Unified AI API 플랫폼 도입 기업에서 운영 비용 최대 80% 절감이 보고되었습니다. 예를 들어, OpenAI GPT-4o 단독 사용 시 1M 토큰당 약 $5.00인 반면, 플랫폼의 자동 모델 라우팅 기능을 활용하면 저비용 모델(예: Mistral Medium, 1M 토큰당 약 $0.40)로 적절한 요청을 분산 처리해 평균 토큰 단가를 60~75% 낮출 수 있습니다. 또한 5개 개별 AI 구독(OpenAI, Anthropic, Google, Mistral, Cohere) 유지 시 월 평균 $2,000~$8,000 수준의 관리 오버헤드가 발생하는데, 단일 플랫폼으로 통합하면 이 비용을 $400~$1,600 수준으로 줄일 수 있습니다.

Unified AI API 플랫폼을 거치면 응답 속도(레이턴시)가 느려지지 않나요?

추상화 계층이 추가되므로 이론상 레이턴시 증가가 우려되지만, 실측 데이터 기준으로 주요 플랫폼(예: OpenRouter, Portkey, LiteLLM)의 추가 레이턴시는 평균 15~40ms 수준입니다. 직접 API 호출 시 GPT-4o TTFT(첫 토큰까지 시간)가 약 320ms라면, 플랫폼 경유 시 335~360ms로 약 5~12% 증가에 그칩니다. 반면 플랫폼의 자동 Fallback 및 로드밸런싱 기능 덕분에 특정 공급자 장애 시 전체 응답 실패율이 직접 연결 대비 평균 67% 감소하며, 실질적인 서비스 가용성은 99.2%에서 99.85%로 향상되는 사례가 보고되어 있습니다.

GPT-4o, Claude 3.5, Gemini 1.5 Pro 중 어떤 모델이 코딩 작업에 가장 성능이 좋은가요?

2026년 기준 주요 코딩 벤치마크 결과는 다음과 같습니다. HumanEval 기준: GPT-4o 90.2%, Claude 3.5 Sonnet 92.0%, Gemini 1.5 Pro 84.1%이며, SWE-bench(실제 GitHub 이슈 해결) 기준으로는 Claude 3.5 Sonnet이 49.0%로 선두, GPT-4o가 46.0%, Gemini 1.5 Pro가 38.2%입니다. 비용 대비 성능 측면에서는 Claude 3.5 Sonnet(1M 입력 토큰당 $3.00)이 코딩 태스크에서 가장 높은 가성비를 보입니다. Unified AI API 플랫폼을 활용하면 이 벤치마크 데이터를 기반으로 태스크 유형별 자동 모델 라우팅을 설정해 코딩 요청은 Claude로, 요약 작업은 Mistral로 분기하는 전략을 코드

Unified AI API 플랫폼 직접 구축 vs 서드파티 솔루션 사용, 어떤 것이 더 나은가요?

직접 구축(Self-hosted) 방식의 경우 LiteLLM 오픈소스 기준 초기 설정에 개발자 1인 기준 약 40~80시간이 소요되며, AWS EC2 t3.medium 기준 월 운영 비용은 약 $30~$60입니다. 반면 PortKey, OpenRouter 등 관리형 서드파티 플랫폼은 무료 티어(월 10만 요청)부터 시작해 Pro 플랜 기준 월 $49~$199 수준입니다. 성능 면에서는 자체 구축 시 레이턴시 오버헤드를 10ms 이하로 최소화할 수 있지만, 보안 패치·모델 업데이트 대응에 월 평균 8~15시간의 유지보수 공수가 추가됩니다. 트래픽이 월 500만 요청 이하인 팀이라면 서드파티 관리형 플랫폼의 TCO(총 소유 비용)가 자체 구축 대비 평균 40% 낮으며, 그 이상 규모에서는 자체 구축이 비용 효율

태그

관련 기사

Seedance 2.0 API 완벽 통합 가이드: Python으로 텍스트-영상 변환

Seedance 2.0 API를 Python으로 완벽하게 통합하는 방법을 단계별로 알아보세요. 텍스트-영상 변환 구현부터 API 인증, 오류 처리까지 실전 코드 예제로 쉽게 따라할 수 있습니다.

DeepSeek API 기업 도입 가이드 2026: 컴플라이언스·SLA·비용

DeepSeek API 엔터프라이즈 도입을 위한 완벽 가이드. 보안 컴플라이언스 요건, SLA 조건 분석, 실제 비용 구조까지 2026년 최신 정보를 한눈에 확인하세요.

SOC2 & HIPAA 준수 AI API 완벽 가이드 | 기업 개발자필독

엔터프라이즈 개발자를 위한 SOC2 및 HIPAA 준수 AI API 선택 기준과 구현 방법을 상세히 설명합니다. 보안 컴플라이언스를 충족하는 AI 통합 전략을 지금 확인하세요.