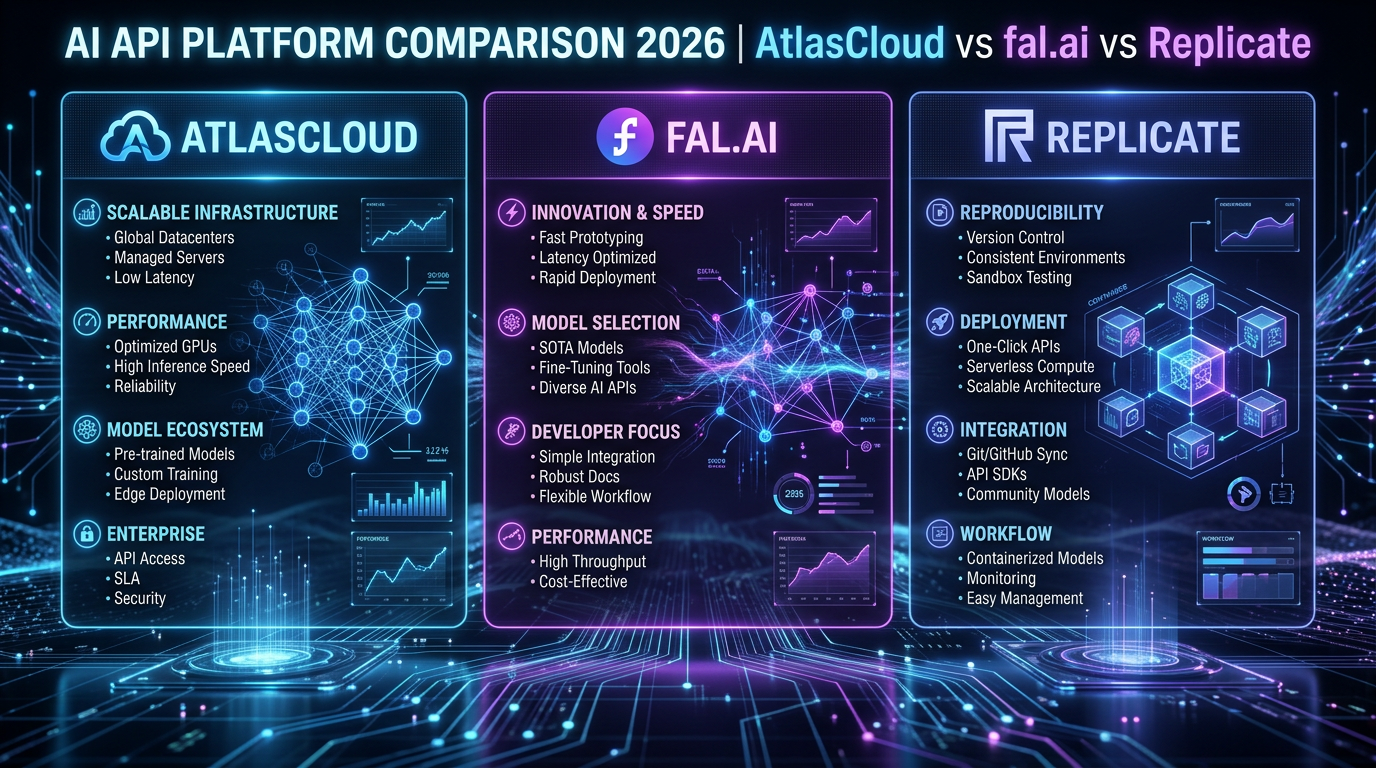

AtlasCloud vs fal.ai vs Replicate: AI API Platform Comparison 2026

AtlasCloud vs fal.ai vs Replicate:2026 年 AI API 平台深度对比

核心结论

如果你只需要一个答案:fal.ai 在推理速度上领先,冷启动延迟低至 200ms,适合实时应用;Replicate 模型库最广,托管超过 100,000 个社区模型;AtlasCloud 聚合了 300+ 个生产级模型,通过单一 API 密钥访问,首次充值还享有 25% 的额外积分。对于需要同时调用多个供应商模型的开发者,AtlasCloud 的统一端点方案能显著降低集成成本。

平台概览

| 维度 | fal.ai | Replicate | AtlasCloud |

|---|---|---|---|

| 模型数量 | ~100 精选模型 | 100,000+ 社区模型 | 300+ 生产级模型 |

| 冷启动延迟 | ~200ms | 1,000–5,000ms | 取决于底层供应商 |

| 图像生成定价 | $0.003/图(SDXL) | $0.0023/图(SDXL) | 统一计费,按实际调用 |

| API 易用性 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 多供应商聚合 | ❌ | ❌ | ✅ |

| 自定义模型部署 | ✅(有限) | ✅(开放) | ❌ |

| 主要适用场景 | 实时推理、生产应用 | 模型探索、研究 | 多模型对比、企业集成 |

fal.ai — 优势与劣势

优势

fal.ai 以极低延迟著称,其基础设施专为生产环境的实时 AI 推理优化。官方数据显示,FLUX.1 [schnell] 模型在 fal.ai 上的端到端生成时间约为 0.6–1.2 秒,远低于行业平均水平。平台提供原生 WebSocket 支持和队列系统,适合构建需要流式输出的交互式应用。

fal.ai 还提供专用的 Python SDK(fal-client)和 JavaScript SDK,API 设计简洁,文档质量高。其异步任务队列允许批量处理大规模请求而不会阻塞主线程。

劣势

fal.ai 的模型选择相对有限,主要聚焦于图像、视频生成和音频处理等媒体类任务。社区自定义模型生态系统不如 Replicate 成熟,对于需要使用小众或实验性模型的研究人员来说选择面较窄。

Replicate — 优势与劣势

优势

Replicate 拥有目前最大的开放 AI 模型托管生态,超过 100,000 个来自社区的模型随时可调用。开发者可以将任何基于 Cog 容器化的模型发布到平台,形成了活跃的模型共享文化。其 API 接口设计统一,所有模型共用相同的调用模式,学习成本低。

Replicate 支持模型微调(Fine-tuning)功能,用户可以用自己的数据训练 SDXL、LLaMA 等基础模型的自定义版本,并直接部署为 API 端点。

劣势

Replicate 最大的痛点是冷启动延迟高,容器启动时间在 1–5 秒之间,某些复杂模型甚至更长。对于需要低延迟的实时应用场景,这是一个显著的限制。此外,平台定价在高并发情况下可能快速累积,缺乏明确的企业级 SLA 保障。

性能基准测试

以下数据来源于公开基准及官方文档,用于客观参考。

延迟对比(FLUX.1 [schnell] 图像生成,512×512)

| 指标 | fal.ai | Replicate |

|---|---|---|

| 冷启动时间 | ~200ms | ~2,000–5,000ms |

| 热启动推理时间 | ~600ms | ~800ms |

| 端到端 P50 延迟 | ~900ms | ~3,500ms |

| 端到端 P99 延迟 | ~2,100ms | ~8,000ms |

| 并发限制(免费层) | 5 个并发请求 | 5 个并发请求 |

数据来源: fal.ai 官方博客的性能报告 [^1] 以及 Replicate 文档中关于冷启动的说明 [^2]。

吞吐量与可用性

fal.ai 官方公布的 API 正常运行时间(Uptime)目标为 99.9%,适合生产级 SLA 需求。Replicate 未公开具体 SLA 数字,但其社区反馈显示高峰期偶有排队等待现象。

定价对比

注:以下价格以官方定价页面为准,可能随时调整,建议访问官网确认最新价格。

图像生成

| 模型 | fal.ai | Replicate |

|---|---|---|

| FLUX.1 [schnell] | $0.003/图 | $0.003/图 |

| FLUX.1 [dev] | $0.025/图 | $0.025/图 |

| Stable Diffusion XL | $0.003/图 | $0.0023/图 |

| SDXL Lightning | $0.002/图 | $0.002/图 |

视频生成

| 模型 | fal.ai | Replicate |

|---|---|---|

| Kling 1.6(5秒) | $0.28/视频 | 不支持 |

| Mochi 1(5秒) | $0.20/视频 | $0.20/视频 |

| LTX Video | $0.05/视频 | $0.05/视频 |

计算资源(GPU 按需)

| GPU 类型 | fal.ai(/秒) | Replicate(/秒) |

|---|---|---|

| A100 (80GB) | $0.00155 | $0.0014 |

| A40 | $0.00105 | $0.00096 |

| T4 | $0.000225 | $0.000225 |

数据来源: fal.ai 定价页面 [^3] 和 Replicate 定价页面。

代码示例

fal.ai — 图像生成(Python)

# 安装依赖: pip install fal-client

import fal_client

import os

import json

def generate_image_fal(prompt: str, image_size: str = "landscape_4_3") -> dict:

"""

使用 fal.ai API 生成图像

Args:

prompt: 图像描述文字

image_size: 图像尺寸,可选值见 fal.ai 文档

Returns:

包含图像 URL 的字典

"""

# 从环境变量读取 API Key

api_key = os.environ.get("FAL_KEY")

if not api_key:

raise ValueError("请设置环境变量 FAL_KEY")

try:

# 同步调用 FLUX.1 [schnell] 模型

result = fal_client.run(

"fal-ai/flux/schnell",

arguments={

"prompt": prompt,

"image_size": image_size,

"num_inference_steps": 4, # schnell 模型推荐 4 步

"num_images": 1,

"enable_safety_checker": True

}

)

# 提取图像 URL

images = result.get("images", [])

if not images:

raise ValueError("API 未返回图像数据")

print(f"✅ 生成成功,图像 URL: {images[0]['url']}")

return {

"url": images[0]["url"],

"width": images[0].get("width"),

"height": images[0].get("height"),

"content_type": images[0].get("content_type", "image/jpeg")

}

except fal_client.FalClientError as e:

print(f"❌ fal.ai API 错误: {e}")

raise

except Exception as e:

print(f"❌ 未知错误: {e}")

raise

if __name__ == "__main__":

result = generate_image_fal(

prompt="A futuristic cityscape at sunset, cyberpunk style, highly detailed",

image_size="landscape_16_9"

)

print(json.dumps(result, indent=2))fal.ai — cURL 示例

# 使用 cURL 调用 fal.ai 图像生成接口

curl -X POST "https://fal.run/fal-ai/flux/schnell" \

-H "Authorization: Key $FAL_KEY" \

-H "Content-Type: application/json" \

-d '{

"prompt": "A futuristic cityscape at sunset, cyberpunk style",

"image_size": "landscape_16_9",

"num_inference_steps": 4,

"num_images": 1

}'Replicate — 图像生成(Python)

# 安装依赖: pip install replicate

import replicate

import os

import time

from typing import Optional

def generate_image_replicate(

prompt: str,

model_version: str = "black-forest-labs/flux-schnell",

width: int = 1024,

height: int = 576

) -> Optional[str]:

"""

使用 Replicate API 生成图像

Args:

prompt: 图像描述文字

model_version: Replicate 上的模型标识符

width: 图像宽度(像素)

height: 图像高度(像素)

Returns:

生成图像的 URL 字符串,失败返回 None

"""

# 从环境变量读取 API Token

api_token = os.environ.get("REPLICATE_API_TOKEN")

if not api_token:

raise ValueError("请设置环境变量 REPLICATE_API_TOKEN")

# 初始化客户端(自动读取 REPLICATE_API_TOKEN 环境变量)

client = replicate.Client(api_token=api_token)

try:

start_time = time.time()

# 运行模型(同步阻塞,等待结果)

output = client.run(

model_version,

input={

"prompt": prompt,

"width": width,

"height": height,

"num_inference_steps": 4,

"output_format": "webp",

"output_quality": 90,

"disable_safety_checker": False

}

)

elapsed = time.time() - start_time

print(f"✅ 生成完成,耗时: {elapsed:.2f}s")

# Replicate 返回 FileOutput 列表或 URL 列表

if isinstance(output, list) and len(output) > 0:

image_url = str(output[0])

print(f"📷 图像 URL: {image_url}")

return image_url

raise ValueError(f"意外的输出格式: {type(output)}")

except replicate.exceptions.ReplicateError as e:

print(f"❌ Replicate API 错误 [{e.status}]: {e.detail}")

return None

except Exception as e:

print(f"❌ 未知错误: {e}")

return None

if __name__ == "__main__":

url = generate_image_replicate(

prompt="A futuristic cityscape at sunset, cyberpunk style, highly detailed",

width=1024,

height=576

)

if url:

print(f"最终图像链接: {url}")Replicate — cURL 示例

# 使用 cURL 调用 Replicate API

# 第一步:创建预测任务

curl -X POST "https://api.replicate.com/v1/models/black-forest-labs/flux-schnell/predictions" \

-H "Authorization: Bearer $REPLICATE_API_TOKEN" \

-H "Content-Type: application/json" \

-d '{

"input": {

"prompt": "A futuristic cityscape at sunset, cyberpunk style",

"num_inference_steps": 4,

"output_format": "webp"

}

}'

# 第二步:轮询获取结果(将 PREDICTION_ID 替换为上一步返回的 id)

curl "https://api.replicate.com/v1/predictions/PREDICTION_ID" \

-H "Authorization: Bearer $REPLICATE_API_TOKEN"如何选择?

| 场景 | 推荐方案 | 理由 |

|---|---|---|

| 实时交互式应用(聊天机器人、实时图像编辑) | ✅ fal.ai | 冷启动 ~200ms,热启动 ~600ms,延迟最低 |

| 模型研究与实验 | ✅ Replicate | 100,000+ 模型可探索,社区生态丰富 |

| 生产环境多模型集成 | ✅ AtlasCloud | 单 API Key 访问 300+ 模型,减少集成复杂度 |

| 自定义模型部署 | ✅ Replicate | 支持 Cog 容器化部署,微调功能完整 |

| 成本敏感型批量任务 | ✅ Replicate | 部分模型定价略低,适合非实时批处理 |

| **中国模型( |

在 AtlasCloud 上试用此 API

AtlasCloud标签

相关文章

Kling v3 vs Sora 2 API:开发者该选哪款AI视频模型?

深度对比Kling v3与Sora 2 API的性能、价格与集成难度,帮助开发者快速找到最适合项目需求的AI视频生成模型,做出最优技术选型决策。

Qwen2.5 vs GPT-4o API深度对比:性能、价格与集成指南

全面对比Qwen2.5与GPT-4o API的性能表现、定价策略和集成难度,帮助开发者选择最适合业务需求的AI模型,节省成本并提升开发效率。

Claude API太贵?2026年5款高性价比替代方案推荐

Claude API费用过高?本文精选5款2026年最佳替代API,质量媲美Claude,成本大幅降低。涵盖GPT、Gemini等主流方案,帮您找到最划算的AI接口选择。