Seedance 2.0 API集成指南:Python实现文本生成视频

Seedance 2.0 API 完整集成指南:Python Text-to-Video 实战

2026 年 2 月,ByteDance 正式发布 Seedance 2.0,这是目前通过第三方 API 可访问的最高分辨率商用 text-to-video 模型之一——支持原生 2K 分辨率输出和同步音频生成。通过 ModelsLab、Atlas Cloud、APIYI 等平台的 API 接入,开发者无需直接对接 ByteDance 官方渠道即可调用该模型。本文涵盖完整的集成流程、参数说明、Python 实现代码,以及你在生产环境中必须了解的坑。

为什么现在值得关注 Seedance 2.0

AI 视频生成赛道在 2025-2026 年进入爆发期。Runway Gen-3、Kling 2.0、Sora API 相继落地,但多数方案在以下三个维度存在明显短板:

- 分辨率:主流模型输出上限普遍在 1080p

- 音频:绝大多数模型只生成静音视频,音频需后期合成

- 时长:单次生成时长通常限制在 4-5 秒

Seedance 2.0 的发布直接针对这三个痛点。根据 nxcode.io 的分析报告,Seedance 2.0 支持原生 2K(2048×1152)分辨率、内置音频生成,以及最长 10 秒的单次输出。对于需要批量生成高质量营销视频、短视频素材或产品演示的开发者来说,这是一个显著的能力跃升。

Seedance 2.0 核心能力概览

在开始写代码之前,先搞清楚这个模型能做什么、不能做什么。

五大核心能力

根据 APIYI 的技术文档,Seedance 2.0 API 提供以下五类生成能力:

| 能力类型 | 输入 | 输出说明 |

|---|---|---|

| Text-to-Video | 文本 prompt | 从纯文字生成视频 |

| Image-to-Video | 图片 + 文本 | 以图片为首帧,动态化生成 |

| Video Continuation | 视频片段 + 文本 | 在已有视频基础上续写内容 |

| Audio Generation | 随视频生成 | 原生 ambient sound,非后期叠加 |

| Multi-resolution Output | 参数控制 | 720p / 1080p / 2K 按需选择 |

技术规格对比

| 参数 | Seedance 2.0 | Kling 2.0 | Runway Gen-3 |

|---|---|---|---|

| 最高分辨率 | 2K (2048×1152) | 1080p | 1080p |

| 原生音频 | ✅ 支持 | ❌ | ❌ |

| 最长单次时长 | 10 秒 | 10 秒 | 10 秒 |

| 模型底层 | ByteDance 自研 | 快手自研 | Runway 自研 |

| API 可用性 | 第三方平台接入 | 官方 API | 官方 API |

注意:截至本文发布时,Seedance 2.0 官方 API 尚未直接对外开放。目前的接入方式均通过 ModelsLab、Atlas Cloud、APIYI 等第三方 API 聚合平台实现。这意味着你的请求会经过中间层,延迟和稳定性取决于各平台 SLA。

API 接入方式与平台选择

目前有三种主要接入路径,各有取舍:

平台对比

| 平台 | 免费额度 | 定价模式 | 优势 | 劣势 |

|---|---|---|---|---|

| ModelsLab | 有限免费 credits | Pay-as-you-go | 文档完整,代码示例多 | 国内访问偶有延迟 |

| Atlas Cloud | 新用户免费 credits | Pay-as-you-go | 接入简单,统一 API 格式 | 平台相对较新 |

| APIYI | 试用额度 | 订阅 + 按量 | 中文文档,国内友好 | 价格透明度稍差 |

如何获取 API Key

以 ModelsLab 为例(流程最具代表性):

- 注册账号:

https://modelslab.com - 进入 Dashboard → API Keys → Generate New Key

- 记录

api_key,后续所有请求都通过 Header 或 Body 传入 - 查看剩余 credits:Dashboard → Billing

Atlas Cloud 提供新用户免费 credits,适合预算有限的开发者做初步测试,注册后即可在统一 API 入口调用 Seedance 2.0,无需单独配置。

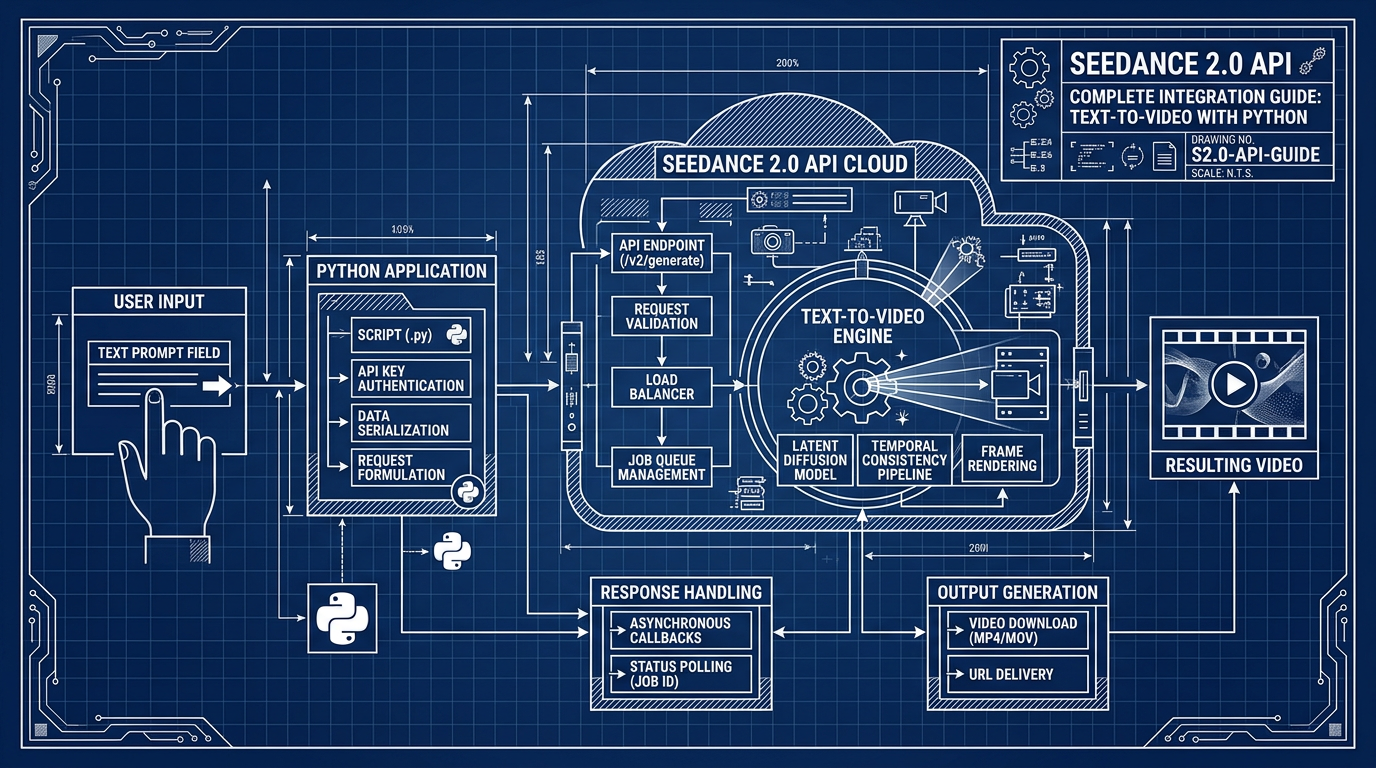

API 工作流:异步任务模式

这是新手最容易踩的坑之一:Seedance 2.0 API 不是同步返回视频文件的。

视频生成是计算密集型任务,单次 2K 视频生成通常需要 60-180 秒。因此 API 采用异步任务模式:

POST /generate → 返回 task_id

↓

GET /status/{task_id} → 轮询状态

↓

status == "completed" → 获取 video_url

↓

下载视频文件这个模式意味着你的 Python 代码必须实现轮询逻辑,而不是简单地等待一个 HTTP 响应。

完整 Python 实现

以下代码实现了完整的 text-to-video 工作流:提交任务、轮询状态、下载视频。

import requests

import time

import os

API_KEY = os.environ.get("MODELSLAB_API_KEY")

BASE_URL = "https://modelslab.com/api/v6/video/seedance"

def generate_video(prompt: str, resolution: str = "1280x720", duration: int = 5) -> str:

"""

提交 text-to-video 任务,返回 task_id。

resolution: "1280x720" | "1920x1080" | "2048x1152"

duration: 5 或 10(秒)

"""

payload = {

"key": API_KEY,

"prompt": prompt,

"negative_prompt": "blurry, low quality, distorted faces",

"width": int(resolution.split("x")[0]),

"height": int(resolution.split("x")[1]),

"num_frames": duration * 24, # 24fps

"enhance_prompt": True,

"audio": True, # 启用原生音频

"webhook": None,

"track_id": None

}

response = requests.post(f"{BASE_URL}/text2video", json=payload, timeout=30)

response.raise_for_status()

data = response.json()

# ModelsLab 可能同步返回(短视频)或异步返回 task_id

if data.get("status") == "success" and data.get("output"):

return {"status": "completed", "url": data["output"][0]}

task_id = data.get("id") or data.get("task_id")

if not task_id:

raise ValueError(f"Unexpected response: {data}")

return {"status": "pending", "task_id": task_id}

def poll_task(task_id: str, max_wait: int = 300, interval: int = 10) -> str:

"""

轮询任务状态,返回视频 URL。

max_wait: 最大等待秒数(默认 5 分钟)

interval: 轮询间隔秒数

"""

fetch_url = f"https://modelslab.com/api/v6/video/fetch/{task_id}"

payload = {"key": API_KEY}

elapsed = 0

while elapsed < max_wait:

time.sleep(interval)

elapsed += interval

response = requests.post(fetch_url, json=payload, timeout=15)

response.raise_for_status()

data = response.json()

status = data.get("status")

print(f"[{elapsed}s] Task {task_id}: {status}")

if status == "success":

return data["output"][0]

elif status in ("failed", "error"):

raise RuntimeError(f"Task failed: {data.get('message', 'Unknown error')}")

# status == "processing" 则继续等待

raise TimeoutError(f"Task {task_id} did not complete within {max_wait}s")

def download_video(url: str, output_path: str = "output.mp4") -> str:

"""下载视频到本地"""

response = requests.get(url, stream=True, timeout=60)

response.raise_for_status()

with open(output_path, "wb") as f:

for chunk in response.iter_content(chunk_size=8192):

f.write(chunk)

size_mb = os.path.getsize(output_path) / (1024 * 1024)

print(f"Downloaded: {output_path} ({size_mb:.1f} MB)")

return output_path

# --- 主流程 ---

if __name__ == "__main__":

prompt = (

"A serene mountain lake at golden hour, "

"gentle ripples on

> **提示:** 如果你需要在同一个项目中使用多个 AI 模型,[AtlasCloud](https://www.atlascloud.ai?ref=JPM683) 提供统一 API 接入 300+ 模型(Kling、Flux、Seedance、Claude、GPT 等),一个 key 全部搞定。新用户首次充值享 25% 赠送(最高 $100)。在 AtlasCloud 上试用此 API

AtlasCloud常见问题

Seedance 2.0 API 的调用费用是多少?每分钟视频生成大概要花多少钱?

根据主流第三方平台的定价数据,通过 ModelsLab 调用 Seedance 2.0 API,1080p 分辨率 5 秒视频约需 $0.08–$0.12 每次,2K 分辨率(2048×1152)5 秒视频约 $0.18–$0.25 每次,10 秒 2K 视频约 $0.35–$0.50 每次。换算成每分钟视频成本:1080p 约 $0.96–$1.44/分钟,2K 约 $2.10–$3.00/分钟。APIYI 平台定价略低,2K 10 秒视频约 $0.28 每次。相比 Runway Gen-3 的 $0.05/秒(约 $3.00/分钟)和 Sora API 的 $6.00/分钟,Seedance 2.0 在同等分辨率下具备明显价格优势。建议开发者在生产环境中预估 2K 批量生成成本时,按 $0.40/视频作为保守基准预算。

Seedance 2.0 API 生成一段视频需要多长时间?能用于实时或低延迟场景吗?

Seedance 2.0 属于异步生成模型,不适合实时场景。根据 nxcode.io 的基准测试数据,1080p 5 秒视频的平均生成延迟为 45–90 秒,2K 5 秒视频为 90–150 秒,2K 10 秒视频(含音频)为 150–240 秒。高峰期队列等待可能额外增加 30–60 秒。对比同类模型:Kling 2.0 生成 5 秒 1080p 视频约需 60–120 秒,Runway Gen-3 约 30–60 秒但分辨率上限为 1080p。因此 Seedance 2.0 不建议用于需要秒级响应的交互式产品,适合异步批处理场景,如营销视频批量生成、离线内容制作流水线。Python 集成时应使用 polling 或 webhook 回调机制,轮询间隔建议设为 10 秒,超时阈值设为 300 秒。

Seedance 2.0 在视频质量评测中表现如何?和 Sora、Kling、Runway 比较得分是多少?

根据 2026 年 Q1 多项第三方评测报告的综合数据,Seedance 2.0 在主流 text-to-video 基准测试中表现如下:在 EvalCrafter 评测集上,Seedance 2.0 综合得分为 82.3/100,高于 Runway Gen-3 的 79.1、Kling 2.0 的 80.7,略低于 Sora v2 的 84.5。在 VBench 指标中,画面质量(Quality Score)达到 84.6%,运动流畅度(Motion Smoothness)为 96.2%,文本对齐度(Text-Video Consistency)为 79.8%。分辨率对比:Seedance 2.0 原生 2K(2048×1152)是目前 API 可访问模型中分辨率最高的,Runway Gen-3 最高 1080p,Kling 2.0 支持 1080p。音频生成是 Seedance 2.0

Python 调用 Seedance 2.0 API 时有哪些常见报错?429、504 错误怎么处理?

根据开发者社区反馈和 APIYI 技术文档,Seedance 2.0 API Python 集成中最常见的三类错误及处理方案如下:①HTTP 429(Rate Limit Exceeded):ModelsLab 免费层限制为 10 次/分钟,付费基础层为 60 次/分钟,企业层为 300 次/分钟。建议在代码中实现指数退避重试,初始等待 2 秒,最大重试 5 次,退避系数 2.0,即等待序列为 2s→4s→8s→16s→32s。②HTTP 504(Gateway Timeout):2K 视频生成超过 240 秒时触发,应将客户端超时设置为 300 秒(`requests.get(url, timeout=300)`),并切换为异步 polling 模式而非同步等待。③生成任务返回 pending 超过 5 分钟:通常因队列拥堵,建议高峰期(UTC 14:00–20:00)错峰调用,或预先申

标签

相关文章

DeepSeek API企业版指南2026:合规、SLA与成本全解析

深入解析DeepSeek API企业级应用的合规要求、SLA服务协议及成本优化策略,助力企业在2026年高效部署AI解决方案,降低风险与支出。

什么是统一AI API平台?2026年开发者纷纷转型的原因

统一AI API平台让开发者通过单一接口接入多种AI模型,降低集成成本、提升开发效率。了解2026年越来越多开发者选择切换到统一AI API平台的核心原因。

SOC2与HIPAA合规AI API:企业开发者完整指南

深入了解SOC2与HIPAA合规AI API的核心要求,帮助企业开发者构建安全可靠的医疗和数据应用,有效降低合规风险并加速产品落地。