什么是统一AI API平台?2026年开发者纷纷转型的原因

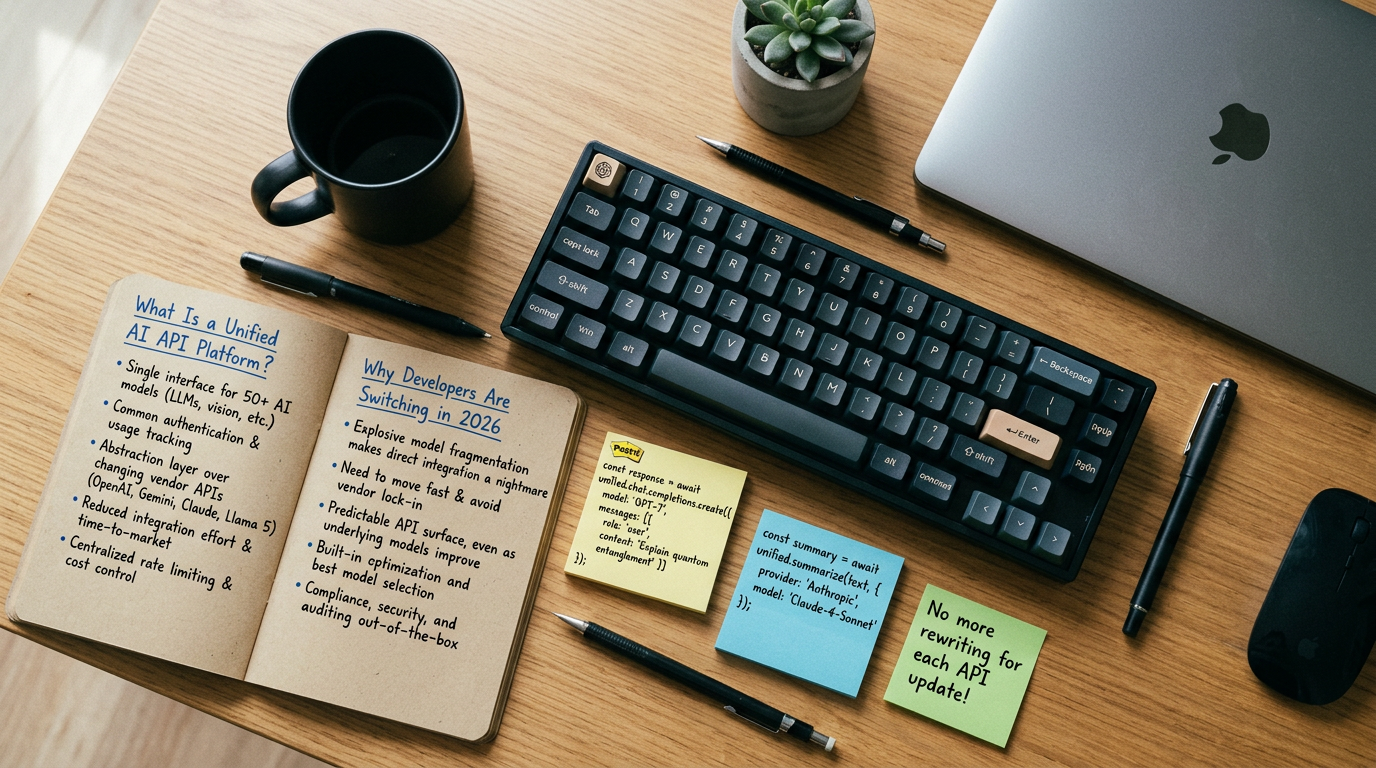

什么是统一 AI API 平台?2026 年开发者为什么纷纷切换

一句话直答: 统一 AI API 平台(Unified AI API Platform)是一个单一接入点,让开发者用同一套代码调用 OpenAI、Anthropic、Google Gemini、Mistral 等多家模型提供商,无需为每家重写集成逻辑。据 Commercial Appeal 2026 年报告,采用”One API”聚合架构的团队平均可削减 80% 的 AI 调用成本;DIMA AI 的调查则显示,头部企业正在从管理 5 个以上独立 AI 订阅,快速转向单一统一平台以控制成本与复杂度。

背景:为什么 2026 年这件事突然变得紧迫

2023 年,大多数团队只需接入 OpenAI 的 GPT-4。2024 年,Claude 3、Gemini 1.5、Llama 3 相继出现,团队开始维护 2-3 个 SDK。到 2026 年,可用的主力模型已经超过 20 个,每个模型在价格、上下文窗口、速度、合规性上的差异越来越大。

这带来了真实的工程成本:

- 重复的集成代码:每新增一个供应商,就要适配一套 API 格式、认证机制、错误码体系。

- 碎片化的账单:5 家供应商就是 5 张发票、5 套用量监控、5 组 rate limit。

- 厂商锁定风险:一旦某家供应商涨价或服务中断,迁移成本极高。

- 模型选型僵化:代码写死了某个模型,即使更便宜、更快的替代品出现也无法快速切换。

unified.to 2026 年最佳统一 API 平台报告指出,“统一 API”这个标签下的产品在架构、数据处理、定价和运营成熟度上差异极大——这也正是开发者需要真正理解它的原因,而不只是跟风使用。

核心概念:统一 AI API 平台究竟做了什么

抽象层的本质

AICC 的定义最为精确:统一 AI API 是一个标准化的单一接口,开发者通过它访问多个 AI 模型和供应商,无需改动应用代码就能切换模型、管理用量、控制成本。

从架构角度看,它做了三件事:

- 协议标准化:将不同供应商的请求/响应格式统一为一套 schema(通常兼容 OpenAI Chat Completions 格式,因为它已成为事实标准)。

- 路由决策:根据规则(成本、延迟、可用性、任务类型)将请求分发到最合适的模型。

- 统一可观测性:跨供应商聚合日志、延迟、token 用量、错误率到同一个 dashboard。

与单纯 SDK 封装的区别

很多开发者最初的做法是自己写一个 LLMClient 类,把各家 SDK 包一层。这不是统一 AI API 平台——差距在于:

| 能力维度 | 自写封装 | 统一 AI API 平台 |

|---|---|---|

| 协议标准化 | 手动维护,易腐化 | 平台持续更新 |

| 自动 Failover | 需自行实现 | 内置,毫秒级切换 |

| 成本路由优化 | 静态配置 | 动态,基于实时价格 |

| 速率限制管理 | 需对每家单独处理 | 统一队列 |

| 账单汇总 | 需人工对账 | 单张发票 |

| 合规审计日志 | 需自建 | 平台提供 |

| 维护成本 | 随供应商数量线性增长 | 固定 |

2026 年主流统一 AI API 平台对比

目前市场上的平台大致分为两类架构:代理型(Proxy-based) 和 聚合型(Aggregator-based)。

代理型:请求经过平台服务器转发,平台可做 caching、审计、路由。代表:LiteLLM(self-hosted)、OpenRouter、Portkey。

聚合型:平台提供统一 SDK,实际请求直接从客户端发往各供应商,平台只做账单和配置管理。代表:部分企业级方案。

核心平台能力对比

| 平台 | 架构类型 | 支持模型数 | 自动 Failover | 成本路由 | 适合场景 |

|---|---|---|---|---|---|

| LiteLLM | 代理型(可自托管) | 100+ | ✅ | ✅ | 内部工具、需要数据私有 |

| OpenRouter | 代理型(托管) | 200+ | ✅ | ✅ | 快速原型、个人开发者 |

| Portkey | 代理型(托管+私有) | 250+ | ✅ | ✅ | 企业生产环境 |

| Helicone | 代理型(托管) | 兼容 OpenAI 格式 | ❌ | ❌ | 纯可观测性 |

| Azure AI Foundry | 聚合型(托管) | Azure 生态 | 部分 | ❌ | 企业 Azure 用户 |

注:模型数量随时变化,以各平台官方文档为准。表格反映 2026 年初状态。

定价与成本结构对比

这是最容易被忽视的部分。统一平台本身的成本叠加在模型调用成本之上:

| 平台 | 平台费用模式 | 额外 markup | 适合月调用量 |

|---|---|---|---|

| LiteLLM(self-hosted) | 免费开源 / 企业版付费 | 0%(直连供应商) | 无限制 |

| OpenRouter | 免费使用 | 部分模型 ~5-10% markup | 中小量(< $500/月) |

| Portkey | 免费额度 + $49/月起 | 0%(透传成本) | 生产级(> $1000/月) |

| 自建封装 | 工程时间成本 | 0% | 视团队能力 |

关键洞察:对于月 AI 支出超过 $2000 的团队,平台 markup 的影响开始显著。此时 self-hosted LiteLLM 或零 markup 的托管方案更合算。

实际效果:统一平台能节省多少

Commercial Appeal 的报告给出了 80% 成本节省的数字,但这个数字需要拆解才有意义——它来自以下几个叠加效应:

成本节省的来源分解

| 节省机制 | 典型节省幅度 | 说明 |

|---|---|---|

| 任务-模型匹配路由 | 40-60% | 用 Mistral 7B 做分类,而不是 GPT-4o |

| Prompt Caching 命中 | 10-30% | 重复前缀自动缓存,Anthropic/OpenAI 均支持 |

| 自动 Failover 减少重试浪费 | 5-15% | 超时不再等待,立即切换备用模型 |

| 批量请求整合 | 10-20% | 部分供应商批量 API 有折扣 |

| 减少过度配置 | 20-40% | 停止默认用最贵模型处理所有任务 |

80% 的数字是叠加理想场景下的上限。实际中等复杂度的应用,30-50% 的成本节省更为现实。

工程时间成本(同样重要)

一个中型团队(3-5 名工程师)自行维护 5 个供应商集成的真实成本估算:

| 工作项 | 首次集成工时 | 每月维护工时 |

|---|---|---|

| SDK 集成 × 5 | 40h | 8h |

| 错误处理 & Retry 逻辑 | 20h | 4h |

| 速率限制管理 | 16h | 3h |

| 账单监控 | 12h | 4h |

| 日志 & 可观测性 | 24h | 6h |

| 合计 | ~112h | ~25h/月 |

切换到统一平台后,维护工时通常降至 2-4h/月(主要是配置调整和模型评估)。

实现:用 LiteLLM 构建一个可路由的统一接入层

以下代码展示了统一 AI API 平台的核心非显而易见的能力:同一套调用代码,通过配置实现自动 Failover + 成本路由。这是自写封装无法轻易复现的。

# pip install litellm

import litellm

from litellm import completion

# 统一接口:model 参数格式为 "provider/model-name"

# 切换供应商只需改这一个字符串,其余代码不变

litellm.set_verbose = False

# 配置 Fallback 链:主模型失败时自动切换

litellm.model_fallbacks = [

{"gpt-4o": ["claude-3-5-sonnet-20241022", "mistral/mistral-large-latest"]},

]

def unified_chat(prompt: str, task_type: str = "general") -> str:

"""

task_type 决定路由策略:

- "complex" → 使用强模型 (gpt-4o)

- "simple" → 使用廉价模型 (mistral/mistral-small-latest)

- "general" → 默认

"""

model_map = {

"complex": "gpt-4o",

"simple": "mistral/mistral-small-latest",

"general": "claude-3-5-haiku-20241022",

}

model = model_map.get(task_type, "claude-3-5-haiku-20241022")

response = completion(

model=model,

messages=[{"role": "user", "content": prompt}],

# Fallback 在 litellm 内部自动处理,调用方无感知

)

return response.choices[0].message.content

# 调用示例 — 切换模型不改业务代码

result = unified_chat("从这段文本中提取关键实体", task_type="simple")这段代码展示的关键点:task_type="simple" 时路由到 Mistral Small(约 $0.1/1M tokens),而 task_type="complex" 路由到 GPT-4o(约 $5/1M tokens)——同样的业务逻辑,成本相差 50 倍。统一平台让这个路由决策变成配置,而不是代码重构。

常见误解与陷阱

误解 1:统一平台意味着”用最好的模型”

实际上恰恰相反。统一平台的核心价值是差异化路由——让对的任务用对的模型。如果你把所有请求都路由给 GPT-4o,你只是加了一层代理,没有获得任何好处。

误解 2:OpenAI 兼容格式 = 真正统一

很多平台声称”兼容 OpenAI API”,但这通常只覆盖 /chat/completions 端点。Embeddings、Function Calling 参数、Vision 输入、Streaming 行为在各家之间仍有细微差异。unified.to 报告明确指出,“统一 API”标签下的产品在架构和数据处理上差异极大,上线前必须测试边界情况。

误解 3:自托管就没有成本

LiteLLM 开源版本免费,但运行它需要:一台服务器($50-200/月)、Redis(用于速率限制,$20-50/月)、日志存储、运维时间。对于月 AI 支出低于 $500 的小团队,托管方案的总成本通常更低。

误解 4:统一平台适合所有人

以下情况不适合使用统一 AI API 平台:

- 只使用一家供应商且短期内无切换计划:增加了一层延迟(代理型通常增加 20-80ms)和依赖,没有对应收益。

- 对数据主权有严格要求且不愿自托管:托管型代理平台会经过其服务器,合规审查需谨慎。

- 月 AI API 支出低于 $100:工程投入 ROI 很低,直接用单一供应商 SDK 即可。

- 需要深度使用某家供应商的专有功能(如 OpenAI Assistants API、Anthropic 的 extended thinking 原生功能):统一层的抽象会遮蔽这些能力。

误解 5:一旦接入就能立刻省钱

成本优化需要主动配置路由策略。平台不会自动知道你的”分类任务”可以用小模型处理——你需要在代码层面做任务分类并映射到路由规则。这是一次性的工程投入,但不可跳过。

选型决策框架

在评估是否切换以及选哪个平台时,用以下问题做快速筛选:

第一步:判断是否需要统一平台

- 当前或计划使用 ≥ 2 个 AI 供应商?→ 是,继续

- 月 AI API 支出 > $200?→ 是,继续

- 有模型切换或 Failover 需求?→ 是,值得评估

第二步:选架构类型

| 需求 | 推荐架构 |

|---|---|

| 数据不出内网 | Self-hosted(LiteLLM) |

| 快速上线,无运维资源 | 托管型(Portkey、OpenRouter) |

| 纯可观测性需求 | Helicone 或 Langfuse |

| 企业合规 + SLA | 企业级托管(Portkey Enterprise) |

第三步:验证关键能力

在正式接入前,至少验证:Failover 切换延迟、你所用的特殊参数(如 response_format、tool_choice)是否透传正确、账单数据粒度是否满足你的成本归因需求。

结论

统一 AI API 平台解决的是一个真实的工程规模问题:当你需要同时使用多个 AI 模型时,重复集成和碎片化管理的成本会快速超过平台本身的开销。它的核心价值不是”访问更多模型”,而是让模型选择变成配置决策,而不是代码重构。选型时最重要的一点:在评估任何平台之前,先算清楚你的实际月支出和供应商数量——这两个数字决定了你能从统一平台中获取多少真实 ROI。

提示: 如果你需要在同一个项目中使用多个 AI 模型,AtlasCloud 提供统一 API 接入 300+ 模型(Kling、Flux、Seedance、Claude、GPT 等),一个 key 全部搞定。新用户首次充值享 25% 赠送(最高 $100)。

在 AtlasCloud 上试用此 API

AtlasCloud标签

相关文章

Seedance 2.0 API集成指南:Python实现文本生成视频

本文详细介绍Seedance 2.0 API的完整集成方案,手把手教你用Python调用文本生成视频功能,涵盖环境配置、接口调用及常见问题解决方法。

DeepSeek API企业版指南2026:合规、SLA与成本全解析

深入解析DeepSeek API企业级应用的合规要求、SLA服务协议及成本优化策略,助力企业在2026年高效部署AI解决方案,降低风险与支出。

SOC2与HIPAA合规AI API:企业开发者完整指南

深入了解SOC2与HIPAA合规AI API的核心要求,帮助企业开发者构建安全可靠的医疗和数据应用,有效降低合规风险并加速产品落地。