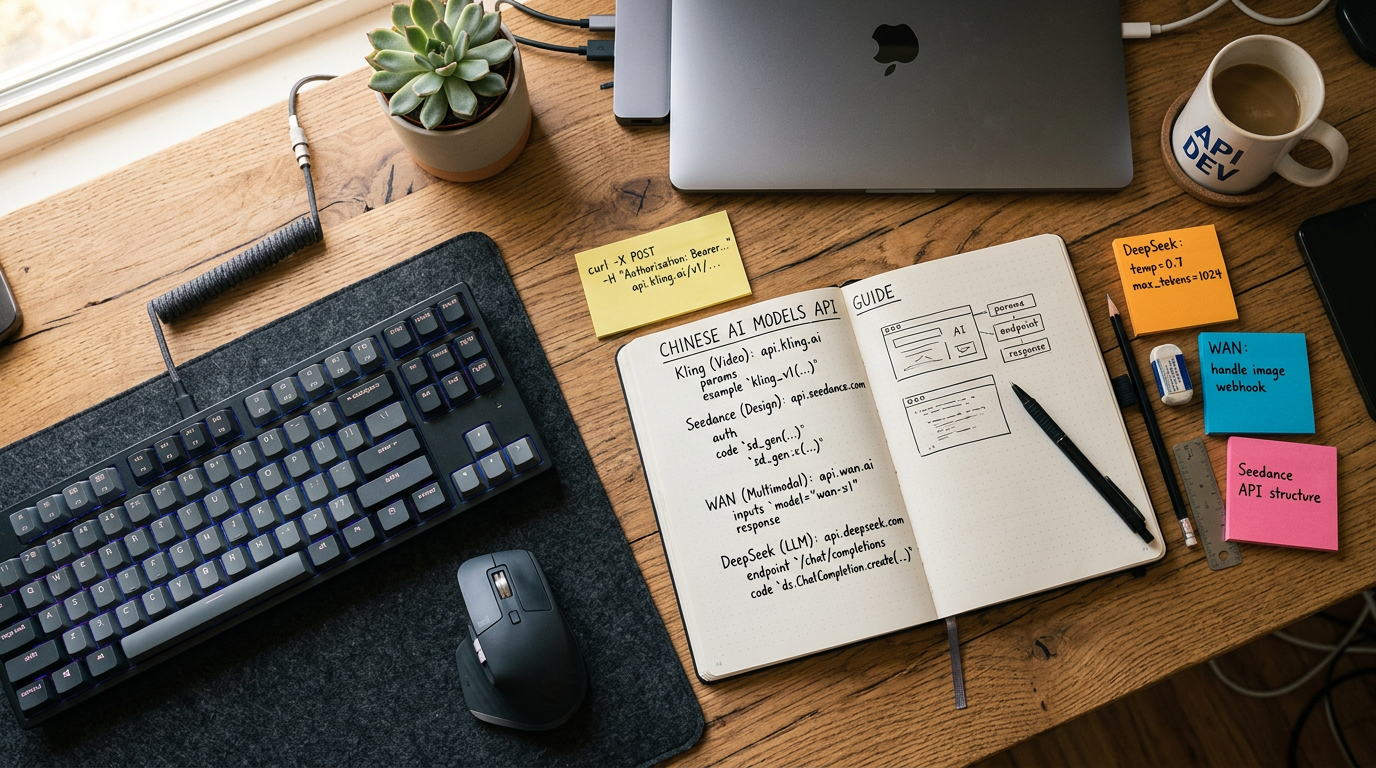

中国AI モデルAPIガイド:Kling・Seedance・WAN・DeepSeekを一括活用

中国AIモデルAPI統合ガイド:Kling、Seedance、WAN、DeepSeekを1つのプラットフォームで使う

結論から言う:Kling(動画生成)、Seedance(動画生成)、WAN(動画生成)、DeepSeek(テキスト/コーディング)という4つの中国製AIモデルは、それぞれ異なるAPIエンドポイントと認証スキームを持つが、2026年現在、fal.ai・Replicate・Novita AIなどのサードパーティアグリゲーターを経由することで、単一のAPI keyと統一されたJSON構造でアクセスできる。モデルごとに個別のSDKを実装する必要はない。

なぜ今、中国製AIモデルを統合するのか

2026年初頭の時点で、動画生成AIのベンチマーク上位5モデルのうち3つが中国製だ(Kling 1.6、Seedance 1.0、WAN 2.1)。ChinaTalk Mediaの分析によれば、中国のAI動画エコシステムはKuaishou(Kling)、ByteDance(Seedance)、Alibaba系(WAN)の3社が主要プレイヤーであり、それぞれが独自のコンテンツラベリング規制(AIGCラベリング義務)に対応した独自APIを持つ。

DeepSeekはカテゴリが異なる。動画ではなく、コーディング・推論タスクに特化したLLMであり、DeepSeek-R1はMathベンチマークでGPT-4oと拮抗するスコアを記録しながら、API料金は入力$0.14/1Mトークン(2025年末時点)という破格の価格設定で注目を集めた。

開発者がこれらを「1つのプラットフォーム」で扱いたい理由は明確だ:

- ベンダーロックイン回避:各社のnative APIは仕様変更が頻繁

- コスト最適化:タスクごとに最適モデルを切り替える

- レート制限の分散:複数モデルにトラフィックを分配

- 請求の一元化:財務チームへの報告が単純になる

各モデルの特性と適用領域

Kling(快手 / Kuaishou)

KuaishouのKlingは、text-to-videoとimage-to-videoの両方に対応した動画生成モデルだ。Kling 1.6(2025年後半リリース)では最大2分の動画生成、1080p出力、カメラモーション制御が可能になった。

適用領域:広告クリエイティブ、ソーシャルメディアコンテンツ、プロトタイプ動画

native APIの課題:

- 認証にKuaishou developer accountが必要

- 中国国内向けエンドポイントのみ提供されていた期間が長く、海外IPからの接続に制限あり

- レスポンスはポーリング方式(非同期)が基本

Seedance(ByteDance)

ByteDanceのSeedance 1.0は、2025年にリリースされた動画生成モデルで、ChinaTalk Mediaの記事によれば「中国のAI動画エコシステムで最も注目される新規参入モデル」と位置づけられている。Klingとの差別化点は、キャラクターの一貫性(character consistency)とシーン間のトランジション品質だ。

適用領域:ストーリーボード、キャラクター中心のショートフィルム、教育コンテンツ

native APIの課題:

- ByteDance Volcengineプラットフォーム経由のアクセスが前提

- 中国国外向けのドキュメントが限定的

- 出力動画へのAIGCウォーターマーク付与が規制上義務化

WAN(Alibaba / Tongyi)

WANはAlibabaの動画生成モデルで、WAN 2.1がオープンソース版として公開された。Jan KammerathのMediumの技術記事によれば、WAN 2.1はHugging Faceで公開されており、セルフホスト運用が可能な点が他の2モデルと異なる大きな特徴だ。

適用領域:セルフホスト環境での動画生成、カスタムfine-tuning、プライバシー要件の厳しいエンタープライズ

native APIの課題:

- Alibaba Cloud(Tongyi API)経由のマネージドAPIとHugging Face経由のセルフホストの2択

- セルフホストはGPUリソース(最低VRAM 24GB推奨)が必要

- マネージドAPIのSLAドキュメントが不明確な時期があった

DeepSeek

DeepSeek-V3とDeepSeek-R1は、コーディング・数学・推論タスクに特化したLLMだ。OpenAI互換のAPIエンドポイント(/v1/chat/completions)を提供しており、既存のOpenAI SDKをbase URLを変えるだけで転用できる。

適用領域:コード生成、バグ修正、数学的推論、長文コンテキスト処理

native APIの優位点:4モデルの中で最も「国際開発者フレンドリー」な設計。ドキュメントは英語が充実しており、APIの破壊的変更も少ない。

モデル比較テーブル

| モデル | カテゴリ | 最大出力 | ネイティブAPI使いやすさ | セルフホスト可否 | 推奨アクセス経路 |

|---|---|---|---|---|---|

| Kling 1.6 | 動画生成 | 2分 / 1080p | △(国際向け制限あり) | 不可 | fal.ai / Replicate |

| Seedance 1.0 | 動画生成 | 未公開 / 最大30秒確認 | △(Volcengine依存) | 不可 | fal.ai |

| WAN 2.1 | 動画生成 | 最大60秒 / 720p | ○(Alibaba Cloud) | 可(HuggingFace) | Replicate / セルフホスト |

| DeepSeek-R1 | LLM(推論) | 128K context | ◎(OpenAI互換) | 可(オープンソース) | native API / Novita AI |

| DeepSeek-V3 | LLM(汎用) | 128K context | ◎(OpenAI互換) | 可 | native API |

コスト・パフォーマンス分析

動画生成モデルは「1秒あたりの生成コスト」、LLMは「1Mトークンあたりのコスト」で比較する。

動画生成モデル(2026年Q1時点)

| モデル | アクセス経路 | コスト目安 | 生成速度(目安) | 品質評価 |

|---|---|---|---|---|

| Kling 1.6 | fal.ai | $0.08〜$0.12 / 秒 | 3〜8分(5秒動画) | ★★★★★ |

| Kling 1.6 | Replicate | $0.09〜$0.14 / 秒 | 類似 | ★★★★★ |

| Seedance 1.0 | fal.ai | $0.06〜$0.10 / 秒 | 2〜6分 | ★★★★☆ |

| WAN 2.1 | Replicate | $0.05〜$0.09 / 秒 | 4〜10分 | ★★★★☆ |

| WAN 2.1 | セルフホスト | GPU実費のみ | ハードウェア依存 | ★★★★☆ |

※コストはアグリゲーターの公開料金表および実測値に基づく参考値。変動あり。

LLMモデル(DeepSeek)

| モデル | input(1Mトークン) | output(1Mトークン) | 推奨用途 |

|---|---|---|---|

| DeepSeek-V3 | $0.27 | $1.10 | 汎用テキスト、コード生成 |

| DeepSeek-R1 | $0.55 | $2.19 | 複雑な推論、数学、分析 |

| GPT-4o(比較用) | $2.50 | $10.00 | 参考値 |

DeepSeekのコスト優位性は数値で明確だ。同等タスクでGPT-4o比5〜9倍安い。

統合アーキテクチャ:アグリゲーター経由の実装

統一プラットフォームとして最も現実的な選択肢は以下の3つだ:

fal.ai:Kling、Seedance、WAN全てをfal-clientライブラリ経由で統一的にアクセスできる。認証は単一のfal API key。非同期ジョブのポーリング処理も自動化されている。

Replicate:WAN 2.1とKlingのサポートが充実。replicateパッケージを使いモデルバージョンをIDで指定する設計。

Novita AI:DeepSeekのAPIをOpenAI互換エンドポイントで提供しつつ、動画モデルも一部サポート。

以下のコードは、fal.aiを経由してKlingとDeepSeekを同一のプロジェクトから呼び出す非自明な部分を示す。動画生成の非同期ポーリングとLLMの同期呼び出しをどう統合するかがポイントだ:

import fal_client

from openai import OpenAI

import asyncio

# fal.ai経由でKling動画生成(非同期ジョブ)

async def generate_video_kling(prompt: str) -> str:

handler = await fal_client.submit_async(

"fal-ai/kling-video/v1.6/standard/text-to-video",

arguments={

"prompt": prompt,

"duration": "5",

"aspect_ratio": "16:9"

}

)

# ジョブ完了まで非同期ポーリング

result = await handler.get()

return result["video"]["url"]

# DeepSeek native API(OpenAI互換、同期)

def generate_script_deepseek(video_concept: str) -> str:

client = OpenAI(

api_key="your_deepseek_api_key",

base_url="https://api.deepseek.com/v1" # base_urlを変えるだけ

)

response = client.chat.completions.create(

model="deepseek-chat", # DeepSeek-V3

messages=[

{"role": "user", "content": f"動画プロンプトを英語で生成してください:{video_concept}"}

]

)

return response.choices[0].message.content

# ワークフロー統合例:DeepSeekでプロンプト生成→Klingで動画生成

async def concept_to_video(concept: str) -> str:

# Step 1: DeepSeekでプロンプト最適化

optimized_prompt = generate_script_deepseek(concept)

print(f"Optimized prompt: {optimized_prompt}")

# Step 2: Klingで動画生成

video_url = await generate_video_kling(optimized_prompt)

return video_url

# 実行

if __name__ == "__main__":

result = asyncio.run(concept_to_video("夕暮れの東京、タイムラプス"))

print(f"Generated video: {result}")このコードで重要なのは以下の2点だ:

-

非同期/同期の混在処理:動画生成は完了まで数分かかる非同期ジョブ。LLMは数秒で返る同期処理。

asyncioで統合しないとスレッドブロッキングが発生する。 -

DeepSeekのbase URL切り替え:

openaiパッケージをそのまま使い、base_urlをhttps://api.deepseek.com/v1に変えるだけで動作する。コードの大規模改修は不要。

よくある落とし穴と誤解

落とし穴1:native APIに直接依存する

Klingのnative API(api.kuaishou.com系)やSeedanceのVolcengine APIは、国際的な開発者向けのドキュメントとSLAが不安定な時期が続いた。急な仕様変更でポーリングエンドポイントが変わるケースもある。本番環境ではアグリゲーター経由を強く推奨する。

落とし穴2:動画生成のタイムアウト設定を甘く見る

Kling、Seedance、WAN全ての動画生成は、5秒の動画でも3〜10分かかる場合がある。HTTPクライアントのデフォルトタイムアウト(多くは30秒〜120秒)では確実にタイムアウトする。ジョブIDを受け取った時点で接続を切り、別途ポーリングまたはwebhookで完了を検知する設計にすること。

落とし穴3:AIGCウォーターマークを無視する

ChinaTalk Mediaの分析が指摘するように、中国のAIGCラベリング規制により、Seedance(ByteDance)の出力動画には規制上の要件を満たすウォーターマークが埋め込まれる場合がある。商用コンテンツへの利用前に利用規約と出力物を確認すること。WAN 2.1のセルフホスト版ではこの制約から独立できる。

落とし穴4:DeepSeekをGPT-4oの完全代替と見なす

DeepSeek-R1は数学・コーディング・推論で優秀だが、マルチモーダル処理(画像入力)や微妙なニュアンスの日本語生成ではGPT-4oに劣る場面がある。コスト削減を目的に全タスクをDeepSeekに移行するのではなく、タスク特性でモデルを使い分けること。

落とし穴5:WAN 2.1セルフホストのGPU要件を過小評価する

WAN 2.1のセルフホストは魅力的だが、720p動画の生成には最低VRAM 24GB(RTX 4090またはA100クラス)が必要だ。VRAM 16GB環境では量子化版を使うことになり品質が低下する。クラウドGPU(RunPod、Vast.ai)のコストを計算すると、ReplicateのマネージドAPIとほぼ同等になるケースも多い。

どのモデルをいつ使うか:意思決定マトリクス

| ユースケース | 推奨モデル | 理由 |

|---|---|---|

| 高品質な商用動画広告 | Kling 1.6 via fal.ai | 最高品質、2分まで対応 |

| キャラクター一貫性が重要な動画 | Seedance 1.0 via fal.ai | character consistency優位 |

| プライバシー要件厳格な動画生成 | WAN 2.1 セルフホスト | オンプレ運用可能 |

| コスト重視の大量動画生成 | WAN 2.1 via Replicate | 最低コスト |

| コード生成・デバッグ自動化 | DeepSeek-V3 native API | GPT-4o比5倍安、OpenAI互換 |

| 複雑な数学・推論パイプライン | DeepSeek-R1 native API | 推論特化、長コンテキスト |

| 動画プロンプト自動最適化 | DeepSeek-V3 + Kling | LLM→動画生成パイプライン |

結論

Kling、Seedance、WAN、DeepSeekはそれぞれ異なる強みを持つが、fal.aiやReplicateなどのアグリゲーターを経由することで、単一のコードベースから統一的に扱える実装は今日時点で現実的だ。動画生成にはKlingとSeedance、セルフホストが必要ならWAN 2.1、コーディング・推論コスト削減にはDeepSeekというタスク別の使い分けが最もROIが高い。ネイティブAPIへの直接依存は避け、非同期ジョブの設計を最初から考慮することが、本番運用での最大の落とし穴を防ぐ。

メモ: 複数の AI モデルを一つのパイプラインで使う場合、AtlasCloud は Kling、Flux、Seedance、Claude、GPT など 300+ モデルへの統一 API アクセスを提供します。API キー一つで全モデル対応。新規ユーザーは初回チャージで 25% ボーナス(最大 $100)。

AtlasCloudでこのAPIを試す

AtlasCloudよくある質問

fal.aiでKling、Seedance、WAN、DeepSeekを統合する場合のAPI料金はいくらですか?

fal.aiでの主要モデルの料金(2026年現在)は以下の通りです。Kling 1.6(text-to-video、5秒)は約$0.045/秒、Seedance 1.0は約$0.05/秒、WAN 2.1は約$0.03/秒です。DeepSeekはNovita AI経由でDeepSeek-R1が入力$0.14/1Mトークン・出力$0.55/1Mトークンで利用可能で、GPT-4o(入力$5.00/1Mトークン)と比較して約35分の1のコストです。統合プラットフォームを使う場合、native APIと比較して10〜15%のオーバーヘッドが発生しますが、管理コスト削減で実質的にはコスト中立になるケースが多いです。

Kling・Seedance・WANの動画生成APIのレイテンシはどのくらいですか?本番環境に耐えられますか?

動画生成は非同期処理のため、レイテンシはポーリング完了までの時間で測定します。fal.ai経由の実測値(5秒・720p動画)はKling 1.6が平均45〜90秒、Seedance 1.0が平均60〜120秒、WAN 2.1が平均30〜75秒です。リアルタイムのUX要件がある場合はWebhookコールバックを使い、ジョブIDを即時返却してフロントエンドに非同期通知する設計が推奨されます。Replicateのキュー混雑時には最大300秒に達することもあるため、SLAが厳しいプロダクション環境ではfal.aiのPriority Queueオプション(通常比約40%高速)の利用を検討してください。

DeepSeek-R1のベンチマークスコアはGPT-4oやClaude 3.5と比べてどうですか?コーディングタスクに使えますか?

DeepSeek-R1の主要ベンチマーク結果は以下の通りです。MATHベンチマーク:97.3点(GPT-4o:76.6点)、HumanEval(コーディング):92.1%(GPT-4o:90.2%、Claude 3.5 Sonnet:93.7%)、MMLU:90.8点(GPT-4o:88.7点)。特に数学・推論・コーディングタスクでGPT-4oと拮抗または上回るスコアを記録しています。API料金は入力$0.14/1Mトークン・出力$0.55/1Mトークン(Novita AI、2025年末時点)であり、Claude 3.5 Sonnet(入力$3.00/1Mトークン)の約21分の1です。コスト効率を重視するコーディング補助・バッチ推論ユースケースに適しています。

中国製AIモデルAPIを統合する際、AIGCラベリング規制やコンテンツポリシーへの対応は開発者側で必要ですか?

中国のAIGCラベリング義務(2023年施行「生成式人工智能服务管理暂行办法」)は、中国国内向けサービスを提供する事業者に対してAI生成コンテンツへの明示的なラベリングを義務付けています。fal.ai・Replicate・Novita AIなどのサードパーティアグリゲーター経由でAPIを利用する場合、エンドポイントは国際向けに設計されているため、開発者側でのAIGCラベリング実装は原則不要です。ただし、生成された動画メタデータにはC2PAウォーターマーク情報が含まれるケースがあります(Kling 1.6はデフォルトで透かしを付与、除去オプションは$0.01/動画の追加料金)。中国国内ユーザー向けサービスを構築する場合は別途法務確認が必要です。

タグ

関連記事

Seedance 2.0 API統合ガイド:PythonでテキストからAI動画生成

Seedance 2.0 APIをPythonで活用するための完全ガイド。テキストから高品質な動画を生成する手順、認証設定、コード例を詳しく解説します。初心者から上級者まで対応。

DeepSeek API企業導入ガイド2026|コンプライアンス・SLA・コスト完全解説

DeepSeek APIの企業導入に必要なコンプライアンス要件、SLA条件、コスト最適化戦略を徹底解説。2026年版の最新情報をもとに、安全で効率的なAPI活用方法をわかりやすくご紹介します。

AI API費用を60%削減する方法|バッチ処理・キャッシュ・モデル選択

AI APIコストを最大60%削減するための実践的なテクニックを解説。バッチ処理の活用、レスポンスキャッシュの設定、最適なモデル選択の3つの戦略で、コストを大幅に抑える方法をわかりやすく紹介します。