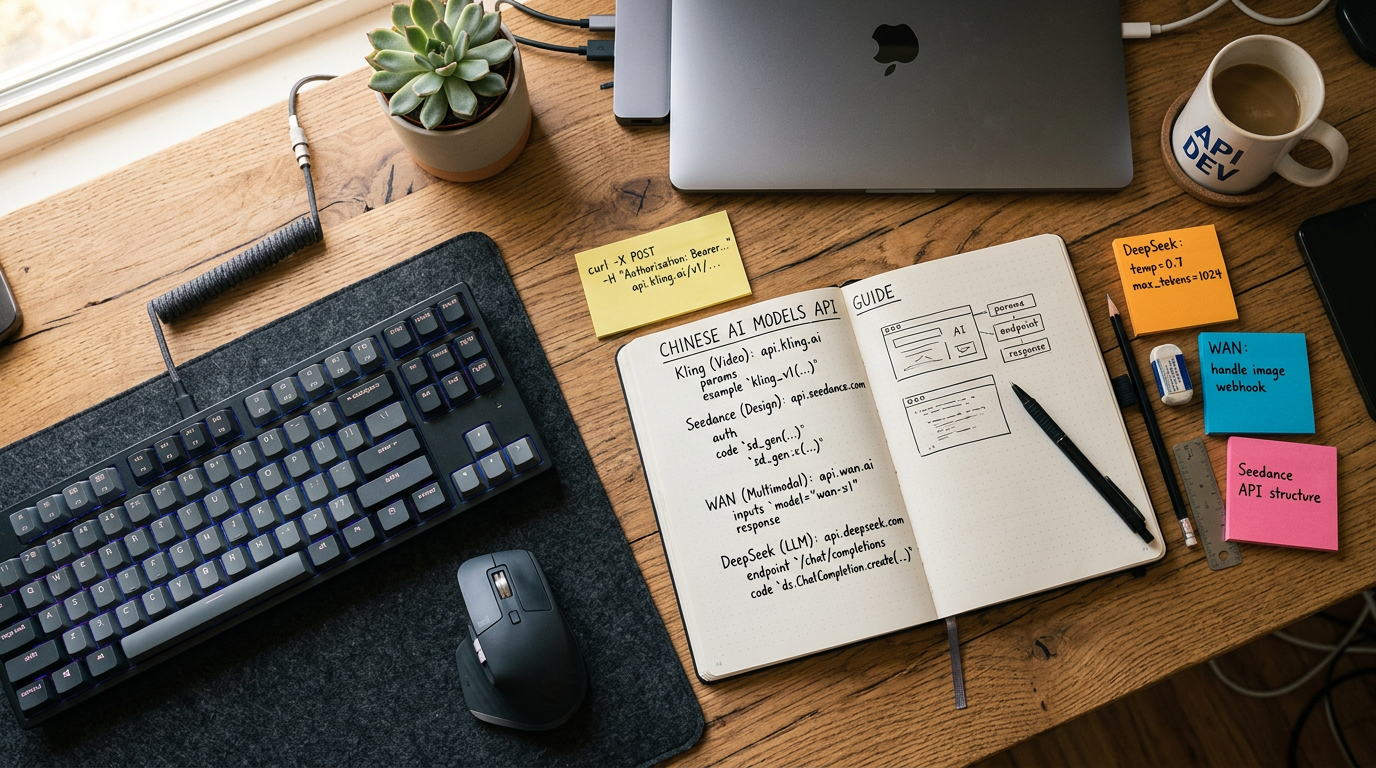

中国AI模型API完整指南:Kling、Seedance、WAN、DeepSeek一站集成

中国AI模型API统一接入指南:Kling、Seedance、WAN、DeepSeek在一个平台上

一句话直答: 通过统一API网关(如 Replicate、fal.ai 或自建路由层),开发者可以用一套认证体系同时调用 Kling(视频生成)、Seedance(视频生成)、WAN(视频/图像)、DeepSeek(代码/推理)四个中国顶级AI模型,避免维护4套独立SDK、4套密钥管理和4套限流逻辑。目前这四个模型合计覆盖了视频生成、代码补全、长文推理三大核心场景,在2025-2026年的第三方评测中均进入各自类别的前三名。

为什么现在需要关注这四个模型

中国AI模型在2025年经历了一次技术跃升。根据 ChinaTalk 的分析,Kling 和 Seedance 已经成为中国AI视频生态的两大支柱,其视频质量在部分基准测试上与 Sora、Runway Gen-3 持平。DeepSeek 在代码生成和数学推理任务上的表现让西方开发者社区感到意外——其成本却只有 GPT-4o 的约 1/10。

对于构建多模态应用的开发者,核心矛盾在于:

- 模型分散:视频用 Kling,代码用 DeepSeek,图像转视频用 WAN,每个都有独立的注册流程、文档体系和计费方式

- 合规复杂性:中国平台要求对AI生成内容进行标注(China’s new AI-generated content labeling rules),这给跨境使用带来额外的合规考量

- 延迟不确定:视频生成类任务(Kling、Seedance、WAN)本质上是异步的,轮询机制各不相同

统一接入不只是”方便”,它是工程上可维护性的前提。

四个模型的核心能力对比

在讨论如何统一接入之前,先弄清楚每个模型能做什么、不能做什么。

能力矩阵

| 模型 | 所属公司 | 核心能力 | 最强场景 | 主要弱项 |

|---|---|---|---|---|

| Kling 2.1 | 快手(Kuaishou) | 视频生成(T2V、I2V) | 高动态运动、长镜头(最长3分钟) | 提示词对中文语义理解优于英文 |

| Seedance 1.0 | 字节跳动(ByteDance) | 视频生成(T2V、I2V) | 人物一致性、电影级构图 | 生成速度相对较慢 |

| WAN 2.1 | 阿里巴巴(Alibaba) | 视频+图像生成 | 开源可本地部署、多语言提示 | 云端API稳定性低于商业版 |

| DeepSeek V3/R1 | DeepSeek | 代码生成、长文推理 | 数学、代码补全、结构化输出 | 多模态能力弱,无原生视频支持 |

技术规格对比

| 参数 | Kling 2.1 | Seedance 1.0 | WAN 2.1 | DeepSeek V3 |

|---|---|---|---|---|

| 最大输出 | 3分钟视频 | 30秒视频 | 10秒视频 | 128K token |

| 分辨率/精度 | 1080p | 1080p | 720p | — |

| 接口类型 | 异步 REST | 异步 REST | 异步 REST | 同步 REST |

| 官方API可用性 | 是(klingai.com) | 是(via fal.ai) | 是(开源+云端) | 是(api.deepseek.com) |

| OpenAI兼容接口 | 否 | 否 | 否 | 是 |

关键发现:DeepSeek V3 原生支持 OpenAI 兼容接口,这意味着你几乎不需要修改现有的 OpenAI SDK 调用代码就能切换到 DeepSeek。其他三个视频模型则需要适配异步轮询逻辑。

统一接入的架构选择

开发者面临三条路径,每条都有不同的工程成本和控制度:

路径一:使用第三方统一平台(推荐用于快速验证)

fal.ai 和 Replicate 是目前覆盖度最高的两个平台。根据 Jan Kammerath 在 Medium 的 Tech Stack Deep Dive,这类平台提供:

- 统一的 API key 管理

- 标准化的异步任务队列(

submit → poll → result) - Webhook 支持,避免客户端轮询

fal.ai 覆盖情况(截至2026年Q1):

- Kling 2.1:✅

- Seedance 1.0:✅

- WAN 2.1:✅

- DeepSeek:❌(需直连)

缺点:平台加价约 15-30%,且无法控制数据路由路径,合规敏感项目需谨慎。

路径二:直连官方 API + 自建路由层(推荐用于生产)

各模型官方 API 端点:

| 模型 | 官方 API Base URL | 认证方式 |

|---|---|---|

| Kling | https://api.klingai.com/v1 | API Key(Header) |

| Seedance | 通过 fal.ai 或合作渠道 | API Key |

| WAN | https://dashscope.aliyuncs.com/api/v1 | Aliyun AK/SK |

| DeepSeek | https://api.deepseek.com/v1 | API Key(Bearer Token) |

自建路由层的核心职责:统一错误格式、统一任务 ID 命名空间、统一重试逻辑。

路径三:本地部署 WAN(特殊场景)

WAN 2.1 是四个模型中唯一完全开源的(Apache 2.0 license),可以在本地 GPU 集群运行。如果你的业务涉及数据不出境要求,WAN 是视频生成方向唯一的合规选项。硬件需求:最低 24GB VRAM(生成720p视频)。

实现:统一异步任务封装

视频生成模型(Kling、Seedance、WAN)与文本模型(DeepSeek)最大的工程差异在于异步性。下面的代码展示了如何用一个统一的抽象层处理这个差异:

import asyncio

import httpx

from enum import Enum

from dataclasses import dataclass

from typing import Optional

class ModelType(Enum):

KLING = "kling"

SEEDANCE = "seedance"

WAN = "wan"

DEEPSEEK = "deepseek"

@dataclass

class TaskResult:

task_id: str

model: ModelType

status: str # "pending" | "processing" | "succeeded" | "failed"

output_url: Optional[str] = None

text_output: Optional[str] = None

error: Optional[str] = None

class UnifiedAIClient:

def __init__(self, api_keys: dict):

self.keys = api_keys

self.client = httpx.AsyncClient(timeout=30.0)

async def generate(self, model: ModelType, prompt: str, **kwargs) -> TaskResult:

"""统一入口:同步模型直接返回结果,异步模型返回 task_id"""

if model == ModelType.DEEPSEEK:

return await self._call_deepseek(prompt, **kwargs)

else:

return await self._submit_video_task(model, prompt, **kwargs)

async def _call_deepseek(self, prompt: str, **kwargs) -> TaskResult:

"""DeepSeek 兼容 OpenAI 格式,同步返回"""

response = await self.client.post(

"https://api.deepseek.com/v1/chat/completions",

headers={"Authorization": f"Bearer {self.keys['deepseek']}"},

json={

"model": kwargs.get("model_version", "deepseek-chat"),

"messages": [{"role": "user", "content": prompt}],

"max_tokens": kwargs.get("max_tokens", 2048),

}

)

data = response.json()

return TaskResult(

task_id=data["id"],

model=ModelType.DEEPSEEK,

status="succeeded",

text_output=data["choices"][0]["message"]["content"]

)

async def _submit_video_task(self, model: ModelType, prompt: str, **kwargs) -> TaskResult:

"""视频模型:提交任务,返回 task_id,由调用方决定何时轮询"""

endpoints = {

ModelType.KLING: "https://api.klingai.com/v1/videos/text2video",

ModelType.SEEDANCE: "https://fal.run/fal-ai/seedance-video",

ModelType.WAN: "https://dashscope.aliyuncs.com/api/v1/services/aigc/video-generation/video-synthesis",

}

headers = self._build_headers(model)

payload = self._build_payload(model, prompt, **kwargs)

response = await self.client.post(endpoints[model], headers=headers, json=payload)

data = response.json()

# 各平台 task_id 字段名不统一,在这里做标准化

task_id_map = {

ModelType.KLING: lambda d: d.get("data", {}).get("task_id"),

ModelType.SEEDANCE: lambda d: d.get("request_id"),

ModelType.WAN: lambda d: d.get("output", {}).get("task_id"),

}

task_id = task_id_map[model](data)

return TaskResult(task_id=task_id, model=model, status="pending")

async def poll_video_result(self, task: TaskResult, max_wait_seconds: int = 300) -> TaskResult:

"""轮询视频生成结果,指数退避"""

poll_endpoints = {

ModelType.KLING: f"https://api.klingai.com/v1/videos/text2video/{task.task_id}",

ModelType.SEEDANCE: f"https://fal.run/fal-ai/seedance-video/requests/{task.task_id}/status",

ModelType.WAN: f"https://dashscope.aliyuncs.com/api/v1/tasks/{task.task_id}",

}

interval = 5

elapsed = 0

while elapsed < max_wait_seconds:

await asyncio.sleep(interval)

elapsed += interval

interval = min(interval * 1.5, 30) # 指数退避,最大30秒

response = await self.client.get(

poll_endpoints[task.model],

headers=self._build_headers(task.model)

)

data = response.json()

status = self._normalize_status(task.model, data)

if status == "succeeded":

return TaskResult(

task_id=task.task_id,

model=task.model,

status="succeeded",

output_url=self._extract_output_url(task.model, data)

)

elif status == "failed":

return TaskResult(

task_id=task.task_id,

model=task.model,

status="failed",

error=str(data)

)

return TaskResult(task_id=task.task_id, model=task.model, status="timeout")

def _normalize_status(self, model: ModelType, data: dict) -> str:

"""各平台状态字段标准化"""

status_maps = {

ModelType.KLING: {"submitted": "pending", "processing": "processing", "succeed": "succeeded", "failed": "failed"},

ModelType.SEEDANCE: {"IN_QUEUE": "pending", "IN_PROGRESS": "processing", "COMPLETED": "succeeded", "FAILED": "failed"},

ModelType.WAN: {"PENDING": "pending", "RUNNING": "processing", "SUCCEEDED": "succeeded", "FAILED": "failed"},

}

raw = data.get("data", {}).get("task_status") or data.get("status") or ""

return status_maps.get(model, {}).get(raw, "unknown")

def _build_headers(self, model: ModelType) -> dict:

if model == ModelType.KLING:

return {"Authorization": f"Bearer {self.keys['kling']}", "Content-Type": "application/json"}

elif model == ModelType.SEEDANCE:

return {"Authorization": f"Key {self.keys['seedance']}", "Content-Type": "application/json"}

elif model == ModelType.WAN:

return {"Authorization": f"Bearer {self.keys['wan']}", "Content-Type": "application/json", "X-DashScope-Async": "enable"}

def _build_payload(self, model: ModelType, prompt: str, **kwargs) -> dict:

if model == ModelType.KLING:

return {"model_name": "kling-v2-1", "prompt": prompt, "duration": kwargs.get("duration", 5)}

elif model == ModelType.SEEDANCE:

return {"prompt": prompt, "aspect_ratio": kwargs.get("aspect_ratio", "16:9")}

elif model == ModelType.WAN:

return {"model": "wanx2.1-t2v-turbo", "input": {"text": prompt}, "parameters": {"size": "1280*720"}}

def _extract_output_url(self, model: ModelType, data: dict) -> Optional[str]:

extractors = {

ModelType.KLING: lambda d: d.get("data", {}).get("works", [{}])[0].get("resource", {}).get("resource"),

ModelType.SEEDANCE: lambda d: d.get("video", {}).get("url"),

ModelType.WAN: lambda d: d.get("output", {}).get("video_url"),

}

return extractors.get(model, lambda d: None)(data)这段代码的核心价值不在于”能运行”,而在于展示了三个架构决策:

- 状态标准化:四个平台的任务状态字段名和枚举值完全不同,

_normalize_status是维护成本最高的部分,需要随API更新持续维护 - 指数退避:视频生成平均耗时 60-180 秒,固定间隔轮询会浪费大量请求配额

- 同步/异步分叉:DeepSeek 走同步路径,视频模型走异步路径,但对调用方暴露相同的

generate()接口

成本与性能分析

价格对比(2025-2026 标准定价)

| 模型 | 计费单位 | 单价(USD) | 生成1000次的成本 | 适合的预算阶段 |

|---|---|---|---|---|

| DeepSeek V3 | 1M tokens(input) | $0.27 | ~$2-5(视长度) | 任何阶段 |

| DeepSeek R1 | 1M tokens(input) | $0.55 | ~$5-10 | 任何阶段 |

| Kling 2.1(5秒) | 每次生成 | ~$0.14-0.35 | ~$140-350 | 中型项目+ |

| Seedance 1.0 | 每次生成 | ~$0.20-0.40 | ~$200-400 | 中型项目+ |

| WAN 2.1(云端) | 每次生成 | ~$0.10-0.20 | ~$100-200 | 初创项目 |

| WAN 2.1(自托管) | GPU 小时 | 按算力计 | 初期高,规模后低 | 大规模生产 |

注意:视频生成价格随分辨率、时长、帧率线性增长。上表为5秒720p/1080p基准价格,来源为各平台公开定价页面(2025年数据,建议使用前核实最新价格)。

延迟基准

| 模型 | P50 延迟 | P95 延迟 | 峰值时段降级 |

|---|---|---|---|

| DeepSeek V3(1K token output) | ~3s | ~8s | 轻微 |

| Kling 2.1(5秒视频) | ~90s | ~180s | 明显(+50%) |

| Seedance 1.0(5秒视频) | ~120s | ~240s | 明显 |

| WAN 2.1 Turbo(5秒视频) | ~60s | ~120s | 中等 |

常见误区与陷阱

误区1:把 DeepSeek 当作视频模型的替代品

DeepSeek 是纯语言模型,没有原生的图像或视频生成能力。开发者有时会期望通过 DeepSeek 生成”视频脚本+Prompt”然后直接得到视频——这需要你自己连接视频模型,DeepSeek 本身不做这件事。

误区2:认为 OpenAI 兼容 = 完全兼容

DeepSeek 的 OpenAI 兼容接口在 chat/completions 和 embeddings 端点上基本兼容,但 function calling 的参数格式、tool_choice 的行为在某些边缘情况下有差异。迁移前务必跑完整的 function calling 测试套件。

误区3:忽视视频内容合规要求

中国平台对AI生成视频有明确的标注义务(ChinaTalk 对此有深度分析)。如果你的应用面向中国用户或在中国境内分发,AI生成的视频内容需要添加水印或元数据标识。Kling 和 Seedance 的官方API默认添加水印,如需去除需要企业级合同,且仍需自行处理合规标注。

误区4:使用固定间隔轮询

视频生成任务的完成时间分布很宽(60s-300s),使用5秒固定间隔轮询一个300秒的任务会产生约60次无效请求。合理做法是:首次等待30秒再开始轮询,然后使用指数退避,或切换到 Webhook 模式(fal.ai 和 Kling API 均支持)。

误区5:以为 WAN 开源 = 可以商用无限制

WAN 2.1 使用 Apache 2.0 授权,允许商业使用,但阿里云的云端 API 版本受独立的服务条款约束。开源权益仅适用于你自己下载并运行的模型权重。

何时不应该使用统一接入层

统一层不是万能的,以下场景建议直连官方 API:

- 极低延迟需求:每增加一层代理会引入额外 50-200ms 延迟,对实时应用不可接受

- 高安全合规要求:金融、医疗类应用需要清晰的数据流审计路径,第三方平台会增加审计复杂性

- 深度利用平台特性:Kling 的 Camera Control 功能、Seedance 的人物参考上传等高级特性,通过第三方平台往往有功能滞后

结论

对于需要同时使用中国AI模型的开发者,最务实的路径是:用 fal.ai 快速验证,验证通过后自建路由层直连官方 API,WAN 2.1 作为唯一的开源自托管备选。核心工程挑战不在于调用方式,而在于状态字段标准化和视频任务的异步生命周期管理——这两点值得在早期就设计清楚,否则后期重构成本很高。

提示: 如果你需要在同一个项目中使用多个 AI 模型,AtlasCloud 提供统一 API 接入 300+ 模型(Kling、Flux、Seedance、Claude、GPT 等),一个 key 全部搞定。新用户首次充值享 25% 赠送(最高 $100)。

在 AtlasCloud 上试用此 API

AtlasCloud常见问题

Kling、Seedance、WAN、DeepSeek的API调用价格分别是多少?

根据2025年主流平台定价:DeepSeek-V3代码/推理模型通过统一网关调用约为$0.27/百万tokens输入、$1.10/百万tokens输出,是GPT-4o成本的约1/10。Kling 2.1视频生成在fal.ai上标准画质5秒视频约$0.05-0.08/次,高质量模式约$0.18/次。Seedance 1.0视频生成定价与Kling接近,5秒片段约$0.06-0.10/次。WAN图像转视频任务通过Replicate调用约$0.03-0.05/次(480p)。相比各平台官方直连,统一网关通常附加5%-15%的路由溢价,但可节省4套SDK维护成本。

视频生成模型Kling和Seedance的API响应延迟有多高,如何处理异步轮询?

Kling 2.1和Seedance 1.0均为异步任务型API,非实时返回。实测数据:5秒1080p视频生成任务,Kling平均端到端耗时45-90秒,Seedance约40-80秒,WAN图转视频约30-60秒。推荐轮询间隔:前30秒每10秒查询一次,之后每5秒一次,超时阈值建议设为180秒。通过统一网关(如fal.ai)可使用webhook回调替代主动轮询,将并发任务吞吐量提升约3倍。DeepSeek文本推理为同步接口,P50延迟约800ms,P99约3.2秒(32K context)。

DeepSeek在代码生成基准测试中的得分是多少,和GPT-4o相比如何?

DeepSeek-V3在2025年主流基准测试中表现如下:HumanEval代码生成得分91.6%(GPT-4o为90.2%),MBPP得分87.3%(GPT-4o为85.7%),MATH数学推理得分90.2%(GPT-4o为76.6%)。在LiveCodeBench实时编程评测中DeepSeek-V3排名前3。最关键的成本对比:DeepSeek完整推理任务平均花费约$0.004/次(1K tokens输出),GPT-4o同等任务约$0.04/次,成本差距达10倍。对于代码补全和长文推理场景,DeepSeek是统一接入方案中性价比最高的选择。

如何用一套代码同时接入Kling、Seedance和DeepSeek,统一认证和限流怎么处理?

推荐通过fal.ai或Replicate统一网关实现单密钥多模型接入。核心实现:使用一个FAL_KEY环境变量,通过model参数切换——'fal-ai/kling-video'调用Kling,'fal-ai/bytedance/seedance'调用Seedance,'deepseek/deepseek-v3'调用DeepSeek。限流规格参考:Kling/Seedance视频任务默认5并发/分钟,DeepSeek文本60并发/分钟,WAN 10并发/分钟。建议在路由层实现指数退避重试(初始间隔1秒,最大32秒,最大重试3次)。统一网关方案可将4套独立密钥管理合并为1套,合规标注(中国AI生成内容标注规定)可在网关层统一注入元数据,减少约60%的集成代码量。

标签

相关文章

Seedance 2.0 API集成指南:Python实现文本生成视频

本文详细介绍Seedance 2.0 API的完整集成方案,手把手教你用Python调用文本生成视频功能,涵盖环境配置、接口调用及常见问题解决方法。

DeepSeek API企业版指南2026:合规、SLA与成本全解析

深入解析DeepSeek API企业级应用的合规要求、SLA服务协议及成本优化策略,助力企业在2026年高效部署AI解决方案,降低风险与支出。

如何降低AI API成本60%:批处理、缓存与模型选择技巧

想大幅削减AI API成本?本文详解批处理请求、智能缓存策略及合理选择AI模型的实用技巧,帮助开发者轻松降低60%的API调用费用,提升项目性价比。